AIは、ただ賢くなっているわけではない。

速くなり、軽くなり、いつでも呼び出される存在になりながら、人の思考、行動、そして使っている「場」そのものに入り込み始めている。

GoogleのAIプロダクトであるGemini 3 Flash、NotebookLM、Opal、Nano Banana、Disco、Playables Builder。

一つひとつは小さな機能追加に見えても、並べてみると、AIの役割がどこへ向かっているのかが浮かび上がってくる。

この記事では、Google AIプロダクトの直近アップデートを手がかりに、いま何が起きていて私たちはどんな変化の只中に立っているのかを整理していく。

高速版「Gemini 3 Flash」リリース

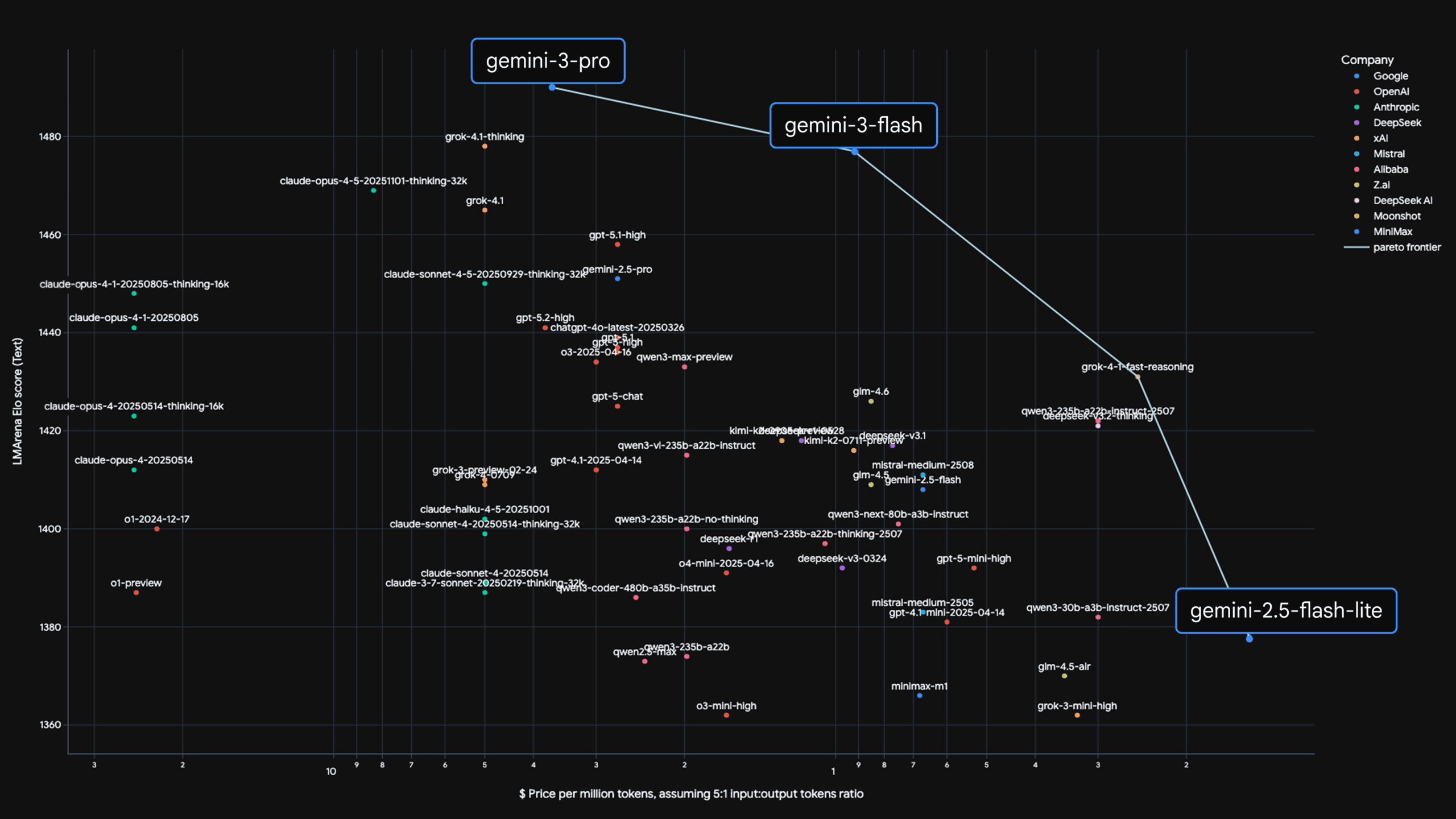

Google は、高速・低遅延・低コストを特徴とする「Gemini 3 Flash」を公開。 Gemini 3 Pro級の推論能力を維持しながら、日常利用や大規模展開を前提に設計されたモデルとされている。

- Gemini 3 Pro 並みの推論能力を継承

- 出力生成速度は Gemini 2.5 Pro 比で約3倍

- 実トラフィック測定でトークン消費量は平均 30% 削減

- 入力100万トークンあたり$0.50、出力$3と低価格

- Google検索のAI Modeでデフォルトモデルとして展開

- Vertex AI・Gemini Enterprise経由で法人向けにも提供

ここで注目したいのは、Gemini 3 Flash が「廉価版」や「簡易版」としてではなく、「最先端の知能を、最も広く配布するための本命モデル」として位置づけられている点。

高性能であることよりも、どれだけの場面に、どれだけ自然に組み込まれるか。

Gemini 3 Flash は、AIの価値基準そのものが変わりつつあることを、示しているのかもしれない。

[related_news id="647"]

[related_news id="640"]

[related_news id="638"]

[related_news id="634"]

Nano Banan Pro、スケッチでAI画像編集が可能に

画像上に直接指やカーソルでスケッチすることで、変更したい箇所をGeminiに正確に伝えられる新しいプロンプト方法を公開。

- 画像上に直接スケッチして指示

- テキストと組み合わせて、視覚的な操作で画像編集

- 画像編集と対話型AIの操作を統合する試み

プロンプトが入力文から、身体的なジェスチャーや視覚的行為へ拡張されつつある兆しにも見える。

プロンプトの「上達」を求める方向ではなく、人間側の自然な指示行為にAIを寄せていくという設計。

AIに何をどう伝えるかではなく、人間同士が普段どのように画像を直したいかを伝えるように、その前提が少しずつUI側で吸収され始めているのかもしれない。

―

GeminiにNotebookLMが統合。ソース設定が可能に。

GeminiにNotebookLMの機能を統合し、ユーザーがNotebookLMにアップロードしたドキュメントや作成したノートなどに基づいて、Geminiとチャットすることが可能になった。

- NotebookLMのドキュメントを Geminiに接続

- Geminiでユーザー固有の資料・ノートを前提にした応答

ここで見えてくるのは、AIが「世界について知っている存在」から、「人がこれまで何を読み、何を考えてきたかを前提に振る舞う存在」へと近づいている変化だ。

検索結果や平均的な答えを返すのではなく、人それぞれに異なる資料やメモを土台に、思考の途中に寄り添う。

その振る舞いは、AIの役割がどこに置かれつつあるのかを静かに示している。

私たちは、知識を得ることよりも、考え続けることそのものを支える方向へ進み始めているのだろうか。

[related_news id="601"]

[related_news id="590"]

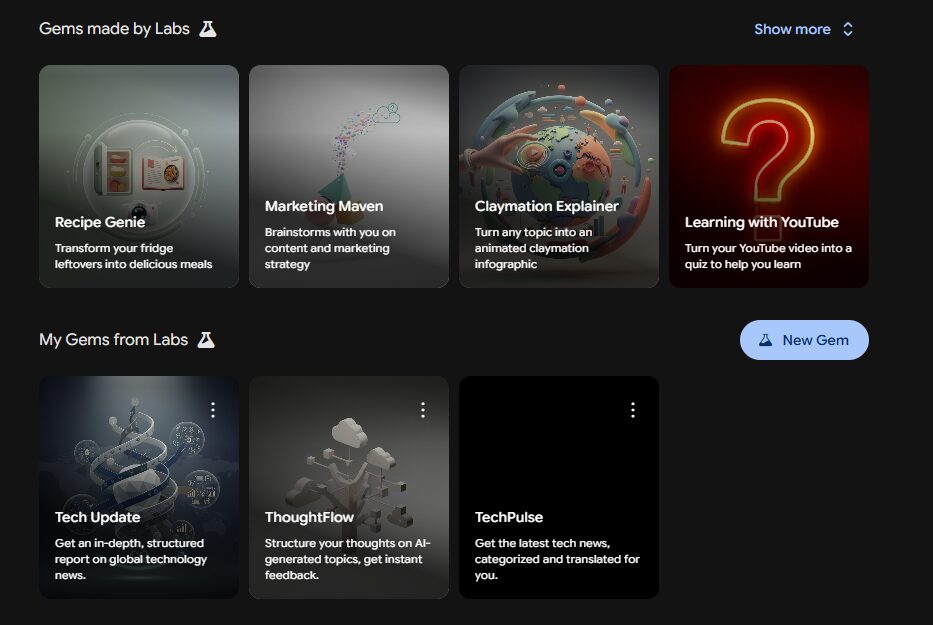

Geminiにバイブコーディングツール「Opal」を統合

バイブ・コーディング向けツール「Opal」を Gemini に統合し、自然言語による指示から、ミニアプリや簡単なツールを生成できる体験を拡張した。

- GeminiからOpalを起動して、自然言語の指示でミニアプリを生成

- ノーコードでミニアプリ作成が簡潔

- Geminiの「Gem」から利用可能

ここで起きているのは、プログラミングを「正確に書く行為」から、試しながら形を探る行為に近づいている動きだ。

完成形を頭の中で設計してから実装するのではなく、曖昧なイメージや途中の思考を、そのまま差し出す。

Opal は、開発という行為を思考の延長線上にある対話的なプロセスとして再定義しようとしている。

作ることと考えることの間にあった摩擦が、少しずつ削られていくとき、「開発」という言葉が指す範囲も静かに変わり始めるのかもしれない。

[related_news id="643"]

[related_news id="633"]

インスタントなウェブアプリを構築する新しい情報提供「Disco」発表

https://youtu.be/9CKeTgcMjzc

実験的な機能として「Disco」および「GenTabs」を公開。AIを用いて、検索やブラウジングの延長線上で、目的に応じた画面や体験をその場で組み立てる簡易的なWebアプリを生成する取り組みを進めている。

- AIが目的に応じたタブ構成やUIを自動生成

- 情報閲覧とツール利用を同一画面上で統合

- Webページを「読むもの」から「使うもの」へ再構成

ここで起きているのは、検索結果を並べることでも、完成されたアプリを配布することでもない。

その場の目的に合わせて、画面や機能そのものが立ち上がる。そうした発想が、ここに持ち込まれている。

あらかじめ用意されたWebサービスを探すのではなく、いま見ている情報を材料にして、必要なかたちを即席で組み上げる。

Disco や GenTabs の試みは、Webを「固定された成果物」ではなく、状況に応じて生成される環境として扱おうとする動きにも見える。

もし画面や機能が、目的ごとにその都度編み直されるものになるとしたら、私たちは、Webを「探す場所」としてどこまで捉え続けるのだろうか。

[related_news id="571"]

[related_news id="561"]

YouTube、Gemini 3を使った「遊べるゲーム制作」を開放

YouTube は、クリエイター向けに「Playables Builder」を公開し、Gemini 3を活用して、動画とは別に実際に遊べるゲーム体験を制作・配信できる仕組みを提供し始めた。コーディングの専門知識がなくても、対話を通じてインタラクティブな体験を形にできる設計となっている。

- Gemini 3を用いたゲーム生成ツールを提供

- 文章による指示からゲームロジックや挙動を構築

- 作成したゲームを YouTube 上でそのまま公開可能

- クリエイター向けの実験的機能として段階的に展開(米国、カナダ、英国、オーストラリア)

ここで起きているのは、「表現の出口」が、再生から体験へと拡張され始めているという変化だ。

これまで YouTube は、見る・聞く・共有するためのプラットフォームだった。

そこに、操作し、結果が変わり、関わり方そのものが分岐する体験が入り込むことで、コンテンツとツール、鑑賞と参加の境界が揺らぎ始めている。

もし表現が視聴されるものではなく、体験されるものとして設計されるようになるとしたら、私たちは YouTube をどんな「場」として使い続けることになるのだろうか。

[related_news id="622"]

「Mixboard」でプレゼン資料生成を拡張

https://youtu.be/5WmC12lsDyQ

「Mixboard」に Nano Banana Pro を統合し、テキストや素材をもとに、プレゼンテーション資料を生成・編集できる機能を拡張した。構成からビジュアル表現までを対話的に組み立てられる設計となっている。

- Nano Banana Proを用いた画像生成やプレゼン資料生成

- テキスト入力からスライド構成・デザインを生成

- 既存素材を組み合わせて編集・再構成が可能

- Google Labsによる実験的機能として提供

ここで起きているのは、「考えをまとめる途中の状態」そのものが、表現として扱われ始めているという変化だ。

これまでプレゼンテーションは、考えが固まったあとに作る成果物だった。

しかし Mixboard では、断片的なメモや曖昧な構想が、そのままスライドという形をとりながら整理されていく。

もし表現が、完成した思考の“出力”ではなく、思考が進行する“場”になるとしたら、私たちは資料を作るという行為を、どのように捉え直すことになるのだろうか。

[related_news id="546"]