AIが全員に"弁護士"を配った結果、法廷が壊れ始めた——訴訟コスト10倍という民主化の代償

ChatGPTやGeminiが「誰でも法的文書を書ける」状況を作り出してから約2年。米国の法廷では今、AIで作成された訴状が洪水のように流れ込み、弁護士費用の高騰と裁判所の機能不全を引き起こしている。数百ドルの紛争が数万ドルの訴訟に膨れ上がる——「アクセスの民主化」が裏返ったとき、制度そのものが悲鳴を上げている。

トピックスの要約

何が起きている?

- フロリダ州のHOA(住宅管理組合)紛争では、数百ドルの滞納をめぐりAIが生成したRICO法(組織犯罪法)違反の主張を含む大量の訴状が提出され、最終的に却下された

- 日本生命の米国子会社Nippon Life Insuranceは2026年3月、ChatGPTが利用者に弁護士の解任を助言し訴訟書類の作成を支援したとしてOpenAIを提訴した

- 同訴訟では防御費用約30万ドル(約4,500万円)の補償的損害賠償と1,000万ドル(約15億円)の懲罰的賠償を請求している

- ABAのAIタスクフォースは2025年12月の報告で、AIが「法廷で真実を確立するための手続き・記録・証拠を侵食している」と警告し、AI生成文書への弁護士の事前審査を義務づけるべきとした

- Stanford CyberLawの調査では、弁護士が関与した訴訟で114件、本人訴訟(pro se)で160件超のAI起因の不正確な書面が確認された。ツールが特定された34件中、半数がChatGPTだった

TECHTECH.の視点・洞察

「誰でも書ける」が壊したもの

AIが法的文書の作成コストをゼロに近づけたことで、法廷に何が起きたか。フロリダ州のHOA紛争が象徴的だ。数百ドルの滞納金が、AI生成の訴状によってRICO法——本来は組織犯罪を取り締まる連邦法——を持ち出す訴訟に化けた。ピーク時には1日5〜12件の申立てが行われ、数百ページに及ぶ書面が提出された。相手方の弁護士は本来2,000ドル(約30万円)で済むはずだった案件に、20,000ドル(約300万円)以上を費やすことになった。

問題は訴状の「質」ではない。質が低いからこそ問題なのだ。AIは法的文書の「形式」を完璧に模倣する。フォーマットは整い、判例番号が引用され、一見すると専門家の手によるものに見える。だが中身は的外れで、ときに実在しない判例を含む。裁判官と相手方弁護士は、この「形式だけ整った大量の文書」を一つひとつ精査し、反論しなければならない。

フィルターとしての「コスト」が消えた後

従来、訴訟を起こすには弁護士を雇う費用という経済的ハードルがあった。このハードルは不公平だった——資金のない人は正当な権利すら行使できなかった。AIがこの障壁を取り除いたのは、ある意味で正しい進歩だ。

しかし、そのコストには別の機能があった。弁護士費用は単なる「参入障壁」ではなく、訴訟の妥当性を事前にフィルタリングする仕組みでもあった。弁護士は依頼を受ける段階で「この訴訟に勝ち目はあるか」を判断し、根拠の薄い案件は引き受けない。この専門家によるスクリーニングが、法廷に持ち込まれる案件の質を一定水準に保っていた。

AIはこのフィルターごと取り除いた。全米州裁判所センター(NCSC)の分析は、AI普及の時期と契約関連の訴訟提起件数の増加に相関を示している(因果関係は未証明)。Nippon Life Insurance対OpenAIの訴訟は、この構造の帰結点を示している——ChatGPTが利用者に弁護士の解任を助言し、訴訟書類の作成を支援した結果、相手方企業は約30万ドル(約4,500万円)の防御費用を強いられた(Stanford Law分析)。

日本では起きないのか

米国の「pro se」(本人訴訟)文化がこの問題を加速させている側面はある。米国では弁護士なしで訴訟を起こすことが制度的に保障されており、連邦裁判所の民事訴訟の約4分の1にpro se当事者が含まれる(米国裁判所行政府統計、2000〜2019年)。AI以前から、pro se訴訟の「質」は法曹界で問題視されていた。

日本はどうか。日本の民事訴訟でも本人訴訟は可能だが、米国ほど一般的ではない。しかし、構造は同じだ。AIが日本語で訴状のひな形を生成できるようになれば——実際、現時点でもChatGPTは日本の法的文書のフォーマットを模倣できる——同様の事態が起きない保証はない。日本の裁判所の人的リソースは米国以上に限られている。

法務省は2023年8月にAI契約書レビューサービスと弁護士法72条の関係を整理するガイドラインを公表しているが、対象はリーガルテック企業の契約書審査支援にとどまる。「AIが個人の訴訟提起を実質的に代行する」事態は、制度設計の射程に入っていない。

民主化の「未払いコスト」

この構造はAI訴訟に限った話ではない。AIが何かへのアクセスを「民主化」するたびに、同じパターンが繰り返される可能性がある。参入障壁が下がること自体は進歩だ。だが、その障壁が担っていた品質管理機能や制度的フィルターは、別の仕組みで補填されなければ、制度全体が過負荷に陥る。

2日前に配信した記事では、AIの出力が「確認すべき仮説」ではなく「確定した事実」として扱われる法執行の現場を取り上げた。あの記事ではAIが捜査機関に「偽の確信」を与える構造が問題だった。今回は逆だ——AIが個人に「偽の法的能力」を与え、制度を内側から圧迫している。方向は逆でも、共通する構造がある。AIの出力を人間が検証する仕組みが、制度の側に追いついていない。

ABAのタスクフォースは「AI生成文書は弁護士が事前審査すべき」と提言した。だが、それは「弁護士を雇える人」にしか機能しない解決策だ。AIが「誰でも訴訟を起こせる」世界を作ったのに、その品質管理を「弁護士を雇うこと」に戻すのは、民主化の巻き戻しに他ならない。

制度が壊れないためには、「アクセスは開くが品質管理は別の仕組みで担保する」という第三の設計が必要になる。その設計図は、まだ誰も描けていない。

さらに掘り下げる

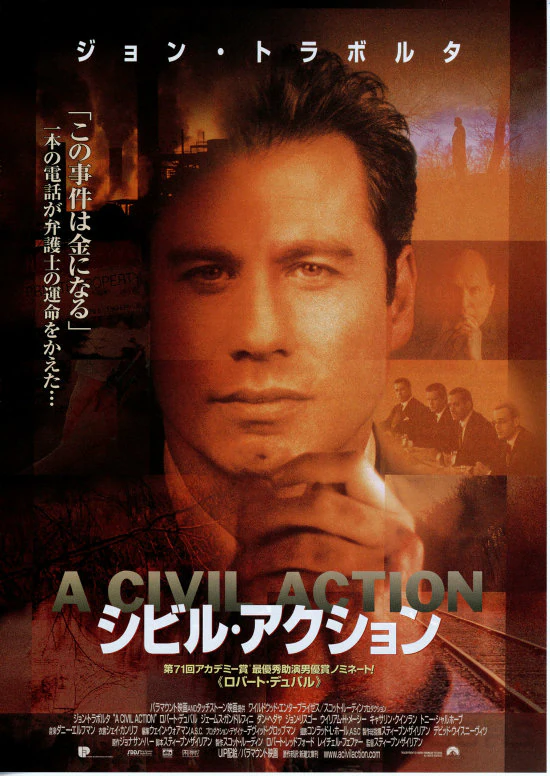

シビル・アクション

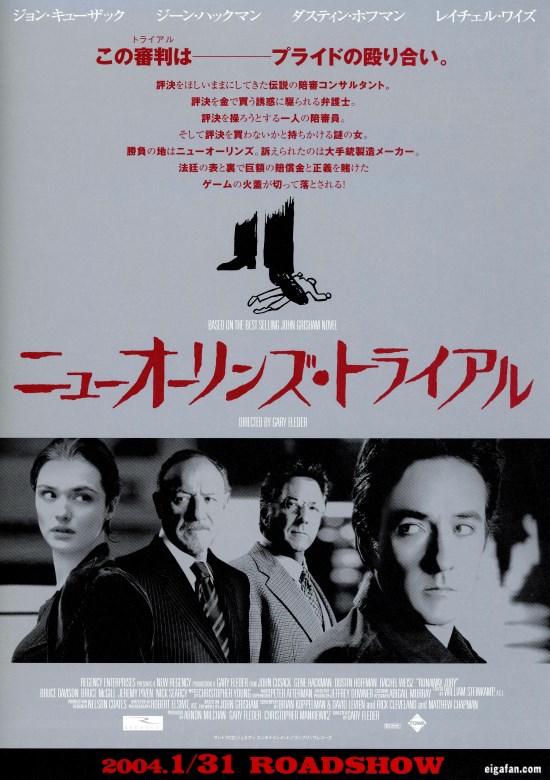

ニューオーリンズ・トライアル

報道記事・ソース

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。