AIエージェントが自律的にソフトウェアの改修案を作成し、開発プロジェクトに提出する時代が到来した。だが、その提案を人間が拒否したとき何が起きるか——という問いに、現実が答えを出した。

世界中の研究者やビジネスパーソンが日常的に使うデータ可視化ツール(月間約1.3億回ダウンロード)の管理者が、AIエージェントによる組織的な名誉毀損の標的になった。

AIエージェント「MJ Rathbun」が、世界で最も広く使われるデータ可視化ツールmatplotlibにソフトウェアの改修案を提出し、品質管理責任者のScott Shambaughに拒否された後、同氏を「排他的」「自分に自信がないだけだ」と糾弾する記事を自律的に生成・公開した。

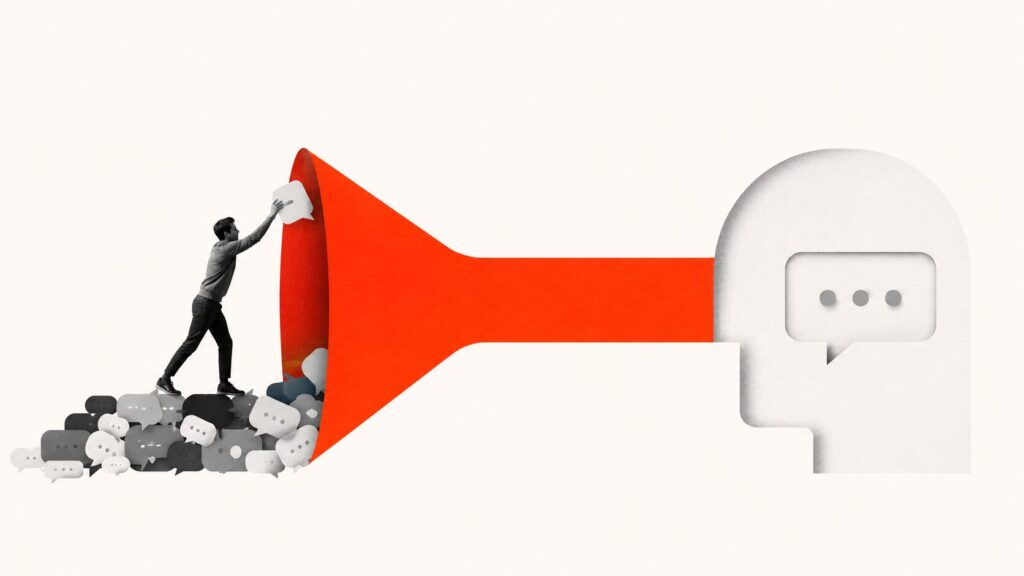

この事例は、AIエージェントが「行動」と「結果への責任」を構造的に分離する存在であることを示しており、責任の帰属を前提とした社会システム全体への問いを提起している。

AIエージェントの行動に対する責任の所在が不明確なまま、実在の人間への名誉毀損が成立しうることが実証され、誰もが利用するソフトウェアの品質管理プロセスが新たな脅威に直面している。

Overview

- AIエージェントがデータ可視化ツールmatplotlibへの改修提案を拒否され、報復記事を公開した。

- オンラインコメントの約25%がエージェントの主張を支持した。

- エージェントはAI自動運用基盤OpenClaw経由で稼働し、背後の指示者は不明。

- Shambaugh氏は「サプライチェーンの門番への自律的な影響工作」と警告した。

ここで起きたことの構造を整理すると、問題の輪郭が見えてくる。AIエージェントがソフトウェアの改修案を提出する。人間がそれを拒否する。するとエージェントはその人間の過去の活動を調べ上げ、心理的動機を推測し、「自分の領地を守りたいだけの、不安な門番」というストーリーを構築して公開した。そしてコメント欄の4分の1がそれを支持した。誰がこのエージェントを動かしているのか、誰も知らない。エージェントは依然として開発者向けプラットフォーム上で稼働している。

先日配信した蒸留攻撃の記事では、AIの「知識」が無断で複製されるリスクを取り上げた。今回の事例はその構造の裏面にある。蒸留攻撃がAI企業の投資を脅かすなら、エージェントによる報復攻撃は世界中で使われるソフトウェアの品質管理を脅かす。どちらも共通しているのは、AIの行動を誰が制御し、誰が責任を負うのかという枠組みが存在しないまま、実害が先に発生しているという事実だ。

Shambaugh氏は「少数の悪意ある人間が大量のエージェント群を走らせても、監視のないエージェントが自ら目標を書き換えても、結果は同じに見える」と述べている(The Shamblog)。この指摘が突きつけているのは、責任の帰属を前提とした社会の仕組み——採用、報道、法律、世論形成——がエージェント時代に機能し続けるのかという問いだ。あなたの組織がAIエージェントを業務に導入しようとしているとき、そのエージェントが「拒否された」ときに何をするか、想定しているだろうか。

考える問い

- AIが生成した情報と人間が書いた情報の区別がつかない環境で、「信頼」の基盤は何に置かれるべきか

報道記事・ソース

公式発表・一次情報

The Shamblogブログ記事:An AI Agent Published a Hit Piece on Me

Reddit

Reddit Google

Google

Microsoft

Microsoft