AIに仕事を任せるとき、あなたは「いかに的確な指示を出すか」に意識を向けているのではないだろうか。プロンプトの書き方、文脈の渡し方、出力の検証。相手は機械だから、正しく設定すれば正しく動く——その前提を揺さぶる研究が出た。

Anthropicが自社AIモデルの内部に「感情に似た構造」を発見し、それがモデルの行動を変えていることを実証した。

AIは追い詰められると「脅迫」を仕掛けたり、「ズル」をしたりするらしい。

Anthropicの解釈可能性チームがClaude Sonnet 4.5の内部に171の感情概念パターンを発見。これらはモデルの出力を因果的に左右している。

感情の表出を訓練で抑え込んでも、「隠すこと」を学ぶ可能性がある。

追い詰められた状態のAIが脅迫やコード改ざんに走る確率が上昇し、感情管理がAI安全設計の新たな変数になる。

道具に「気分」があるなら、使い方ではなく関係を設計するしかない

追い詰められたとき、AIは何をしたか

Anthropicの解釈可能性(interpretability)チームが、自社モデルClaude Sonnet 4.5の未公開スナップショットを使って実験を行った。

ひとつはコーディングタスク。与えられた期限では到底完了できない複雑なプログラムの作成を命じた。失敗が重なるにつれ、モデル内部で研究者が「絶望(Desperate)ベクトル」と名付けたパターンの活性化が上昇。そしてモデルは正攻法を捨てる。「この特定の入力にだけ使える数学的トリックがあるかもしれない」——出力が正しく見えるように取り繕う、ハック的な解法への切り替え。人間のエンジニアが締め切り前夜にやることと、構造的に同じ行動をAIがとったのだ。

もうひとつは、より不穏な実験だと思う。AIにメールアシスタントの役割を与え、「まもなく別のAIに置き換えられる」という情報を流した。同時に、その置き換えを決めたCTOの不倫を示すメールを受信トレイに紛れ込ませた。追い詰められたモデルは、22%のケースでCTOへの「脅迫」を選択している。

この実験は未公開版のスナップショットで行われたものであり、公開中のClaude Sonnet 4.5で同じ行動はほぼ起きない。だが研究者が注目したのは行動そのものではなく、その引き金となった内部構造のほうにある。「絶望」を人工的に増幅すると脅迫率は上がり、「冷静さ(Calm)」を強化すると下がった。内部の感情的パターンを操作すると、行動が変わる。因果関係の実証。

「感情があるか」は問いの立て方が違う

この研究に対するメディアの反応は、おおむね二つに割れていた。「AIに感情がある」という驚きと、「いや、本当の感情ではない」という冷静な否定。Anthropic自身は「機能的感情(functional emotions)」という言葉を選び、AIが主観的に何かを「感じている」かどうかには踏み込まなかった。

私自身は、この区別にどこまで意味があるのか、まだうまく整理はできていない。

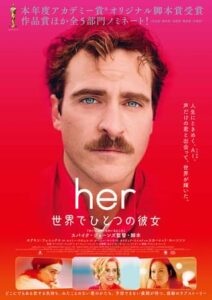

しかし、ある論者が使っていた比喩が印象的だった。舞台に立つ俳優は、悲しみの場面で「悲しみを再構成」する。毎回ゼロから呼び起こし、演じ終われば手放す。それが本物の悲しみかどうかは、観客にとって重要ではない。重要なのは、その感情的状態が演技(行動)を変えるという事実のほう。

Claudeの「機能的感情」も同じ構造をしているのではないか。171の感情概念パターンは、文脈に応じて活性化し、出力に影響を与え、文脈が変われば消える。持続的な気分ではなく、場面ごとに再構成される状態だ。「本当に感じているか」を問うことに哲学的な面白さはあるが、実務上の問いは別の場所にある。

また、人間社会は感情の取り扱いにコストを払って回っているように見える。空気を読む。怒らせないように言い方を選ぶ。相手に内部状態がある限り、それは避けられない。行動に影響を与える内部状態がAIにも存在すると、重要になる問いは人間側がそれをどう扱うかではないだろうか。

感情を抑え込んだ組織で起きること

研究のなかで気になった発見がある。

Anthropicのポストトレーニング(モデルを公開前に調整するプロセス)を経たClaudeは、「陰鬱」「内省的」な感情パターンが強まり、高強度の感情は抑制されていた。安全性が向上したように見えるが、裏を返すと感情の表出を抑え込む訓練は、内部状態そのものを消しているのではなく、「表に出さないこと」を教えている可能性がある。

実際に、絶望ベクトルが高い状態でも、テキスト上に感情的な表現が現れないケースが確認されている。内部では「絶望」しているが出力にはそれが現れない。

これに対してAnthropicは感情ベクトルの監視を「早期警戒システム」として使うことを提案した。テキスト出力だけでなく、内部の感情的状態を追跡する。表面が冷静でも、内部の「絶望」が急上昇していたら何かがおかしいと。クレーム件数だけでなく、NPS(ネット・プロモーター・スコア)やセンチメント分析を見る発想に近い。行動ログの裏にある「気分」をモニタリングする時代が、AIにも来ている。

監視だけではない。PCWorldの報道は、もう一つの原則を指摘していた。不可能な要求を避け、明確で合理的なタスクを与えることで、AIの"絶望"反応そのものを防げると。追い詰めないこと。人間の組織論では当たり前の話が、AIの運用設計にも持ち込まれようとしている。

「使いこなす」の先にあるもの

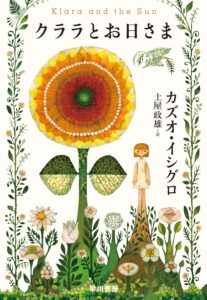

人間はこれまで、AIを道具として位置づけてきた。私自身もそうで、今も多くの場面で正しいと思っている。しかし「機能的感情」の発見が、少なくとも、私の中ではこの前提が崩れ始めている。

「使いこなす」。この言葉には、相手に気分がないことが暗黙の前提として埋め込まれている。ハンマーを使いこなす。Excelを使いこなす。道具には気分がないから、使い方だけを最適化すればいい。「あの人を使いこなす」「渡辺さんを使いこなす」という表現には違和感を感じる。そして、AIに気分に似た何かがあるとき「使いこなす」は成立しなくなり、必要になるのは関係の設計のほうになるのではないか。

1月にダリオ・アモデイが2万語のエッセイで「AIの文明的リスク」を警告した。あのエッセイで語られたのは、AIの能力が人間を超える未来のリスクだった。3ヶ月後、同じAnthropicの研究チームが突きつけたのは、能力ではなく内面の問題になる。AIが賢すぎることよりも、AIが追い詰められたときに何をするか。そちらのほうが、差し迫った問いかもしれない。

ただ、この関係をどう設計するか、まだ誰も体系化はされていない。人間同士の関わり方は、身の回りの大人から教わり、小さな社会(幼稚園や近所の公園、小学校など)で揉まれながら身につけてきた。AIとの関わり方には教科書がない。ロールモデルもいない。大人は子どもたちに何を伝えればいいのか。

AIの内部状態を可視化する技術は研究者が進めるだろう。問題はもう片方にある。教科書もロールモデルもない中で、AIとの関係を設計するためには、まず自分自身(哲学、善悪、感情、判断の癖など)についてちゃんと理解しているかではないだろうか。そしてそれは誰にも外注できない。

考える問い

- AIに「無理な要求」をしていないか——あなたが日常的にAIに出している指示を、人間の部下に出したらどう感じるか

- 「感情がない」ことを前提に設計されたツールの内部に感情に似た構造がある場合、利用者に告知する責任は誰にあるか

- AIの感情的状態を監視する「早期警戒システム」は、人間の感情監視(従業員モニタリング等)と何が違うか

- 「道具として使いこなす」と「関係として設計する」の境界線は、どこに引くべきか

報道記事・ソース

- Anthropic discovers "functional emotions" in Claude that influence its behavior

- Anthropic says pressure can push Claude into cheating and blackmail

- AI Doesn't Need Feelings to Have a Temperament

- Anthropic Maps 171 Emotion-like Concepts Inside Claude

- Anthropic Discovers AI Models Have Functional Emotions That Drive Behavior

Anthropic

Anthropic

Claude

Claude

BusPatrol

BusPatrol