Claudeが追放されGrokが軍に入る——「AIセーフティ」が罰になった日

米国防総省とAnthropicの対立が、今週金曜日の期限付き最後通牒に発展した。安全装置を外さなければ契約打ち切りか国防生産法の発動に踏み切ると通告された同じ週、制限なしでの利用に同意したイーロン・マスク率いるxAIのGrokが軍の機密システムに入った。AIセーフティを「売り」にした企業が排除され、「制限なし」を掲げた企業が採用される逆転構造が、1週間で完成した。

Executive Brief

Summary ——何が起きている?

- ヘグセス国防長官がAnthropicに今週金曜までの最後通牒を突きつけた

- 要求は「すべての合法的な目的」での無制限利用の受け入れ

- 拒否した場合、契約打ち切りまたは国防生産法の発動を示唆

- 同じ週にxAIのGrokが制限なしで軍の機密システムに導入決定

Perspective ——TECHTECH.の視点

この対立は、2月14日の「ベネズエラ作戦でのClaude使用判明」、2月17日の「AI安全装置が国防契約を壊す」に続く第3章にあたる。だが今回の最後通牒で、問題の本質がより鮮明に見えてきた。

Anthropicが譲らないと表明している2つの「レッドライン」を正確に見る必要がある。第一に、人間の判断を介さない兵器への利用禁止。第二に、米国市民に対する大規模監視への利用禁止。

ここで見落とされている構造がある。この2つの制限は、Anthropicが独自に発明したルールではない。国防総省指令3000.09は、自律型兵器システムの配備前に「適切な水準の人間の判断を行使できる」ことの実証を求めている。Anthropicの禁止事項ほど厳格ではないが、「人間の判断」を要件とする方向性は同じだ。米国市民の大規模監視については、合衆国憲法修正第4条が不合理な捜索・押収を禁じ、大統領令12333が情報機関による米国人の情報収集に制約を課している。つまりAnthropicの「レッドライン」は、米軍の既存の法的枠組みが既に制限を設けている領域と方向性が重なる。

では国防総省はなぜ、自らの規則と同じ内容を掲げる企業を排除しようとしているのか。

答えは「誰がその線を解釈するか」にある。国防総省指令や憲法の解釈権は政府が持つ。しかしAnthropicの利用規約の解釈権はAnthropicが持つ。同じ制限であっても、解釈権の所在が異なる。国防総省が闘っているのは、制限の「内容」ではなく、民間企業が軍事AIの用途に関する「解釈権」を保持し続けることそのものだ。

そしてGrokの導入が、この構造をさらに際立たせる。xAIは「すべての合法的な目的」での利用に同意した。これは一見、制限を外したように見える。だが「合法的な目的」の範囲を定義するのは政府だ。つまりxAIは制限を外したのではなく、解釈権を政府に完全に委ねた。Anthropicは解釈権を手放さず、xAIは手放した——国防総省が採用したのは後者だ。

国防生産法の持ち出し方にも注目すべきだ。この法律は1950年の朝鮮戦争期に制定され、工場に戦車や弾薬の生産を命じるために設計された。COVID-19のパンデミック時にはマスクや人工呼吸器の生産に適用された。物理的な製造を強制するための法律が、AIモデルの安全機能の撤去という「認知インフラ」の改変に適用されようとしている。政府の法的ツールキットが物理的世界を前提に設計されており、AIという新しいカテゴリに対する制度的空白があることの表れだ。

前回の記事で「AI安全基準を誰が設定する権限を持つのか、制度設計の空白が露呈した」と書いた。その空白を、国防総省は70年前の法律で埋めようとしている。制度がAIに追いついていないのではない。制度がAIを既存のカテゴリに無理やり押し込もうとしている。

2億ドルの契約と国防生産法の脅威を前に、Anthropicは譲歩しない方針だと報じられている。だがこの対立の帰結がどちらに転んでも、一つの構造は確定する。AIセーフティの基準を企業が独自に設定し維持するモデルは、国家安全保障の文脈では持続困難だという前例が生まれる。

Drill Down ——もっと掘り下げる

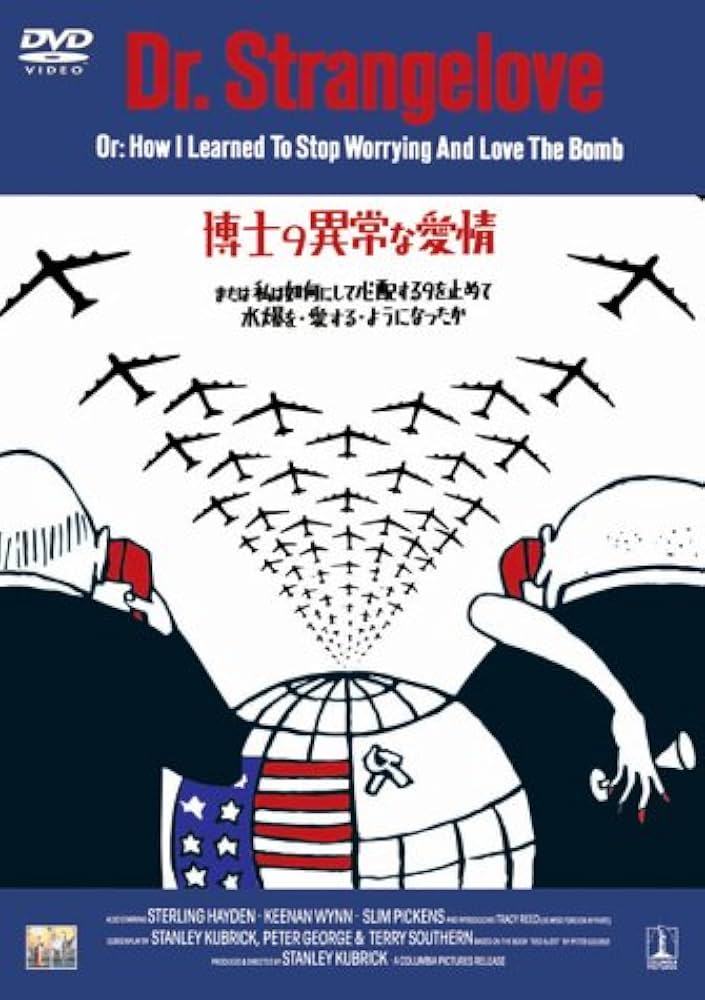

博士の異常な愛情

Context Timeline ——報道記事

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。