AIが作ったコンテンツをAIが裁く時代——Metaが進める「人間なき品質管理」の行方

2025年1月にサードパーティのファクトチェック・プログラムを廃止し、コミュニティノート方式へ移行したMeta。今度は、コンテンツモデレーションを担ってきた外部ベンダーの役割を「数年かけて」縮小し、AIシステムに置き換えると発表した。Accenture、Cognizantといった外部ベンダーが担ってきた業務が対象だ。Metaは「人間の判断を置き換えるものではない」と強調するが、人の目が関与するレイヤーが一つずつ外されている。

トピックスの要約

何が起きている?

- 新AIシステムはインターネット利用者の98%が使用する言語に対応し、従来の80言語カバーから拡大した

- 著名人のなりすまし報告を80%以上削減し、深刻な違反広告のページビューを7%減少させたと発表した

- 移行は「数年」をかけて段階的に行われ、人間のレビュアーは控訴処理や法執行機関への照会など「最もリスクが高く重要な判断」に残るとされる

- Metaは2025年1月にサードパーティのファクトチェック・プログラムを廃止し、コミュニティノート方式への移行を開始していた

TECHTECH.の視点・洞察

ファクトチェッカーの次は、モデレーター

時系列を整理する。2025年1月、Metaはサードパーティのファクトチェック・プログラムを廃止し、Xのコミュニティノートに類似した方式へ移行した。そして2026年3月、外部ベンダーのコンテンツモデレーターを「数年かけて」AIに置き換えると発表した。2つの発表の間に見えるのは、コンテンツの品質管理に関わる「外部の人間の目」が、一つずつ体系的に外されているという構造だ。

Metaの主張は明快だ。AIの検出率は人間チームの2倍、誤検出は60%以上削減。数字だけ見れば合理的な判断に見える。だが、ファクトチェッカーを廃止したときも同様の論理——「バイアスのある外部チェックより、コミュニティの集合知のほうが公平」——が語られた。問題は個々の判断の精度ではなく、外部からの検証レイヤーが消えるという構造的変化にある。

「人間の判断は置き換えない」の意味範囲

Meta公式ブログの「AIは人間の判断を置き換えるものではない」という一文は注意深く読む必要がある。人間が残る領域は「控訴処理」「法執行機関への照会」「最もリスクが高い判断」とされている。つまり、日常的なコンテンツの判定——数十億件の投稿を「違反か否か」振り分ける作業——はAIに移る。

15,000〜20,000人と推定される外部モデレーターが担ってきた業務の大半は、この「日常的な判定」だ。残される「人間の判断」は、AIが判定した結果に対する例外処理に限定される。判定の主体がAIに移り、人間は「異議があった場合の受け皿」として残る。主客が逆転している。

70%の失敗率と「2倍の検出率」の間

ここで思い出すべき事実がある。2月に取り上げた記事で触れたとおり、MetaのAIチャットボットは未成年の性的搾取防止に約70%の確率で失敗していたことが、ニューメキシコ州の裁判で同社の内部テスト資料から明らかになっている。

そのMetaが、今度は「AIの検出率は人間の2倍」と発表している。矛盾ではない。対象領域が異なる。だが、「AIのほうが優れている」という主張は、その主張を検証する外部の目が減るほど、確かめようがなくなる。自社AIの性能を自社が評価し、自社が発表する。独立した検証がなければ、数字の意味は変わる。

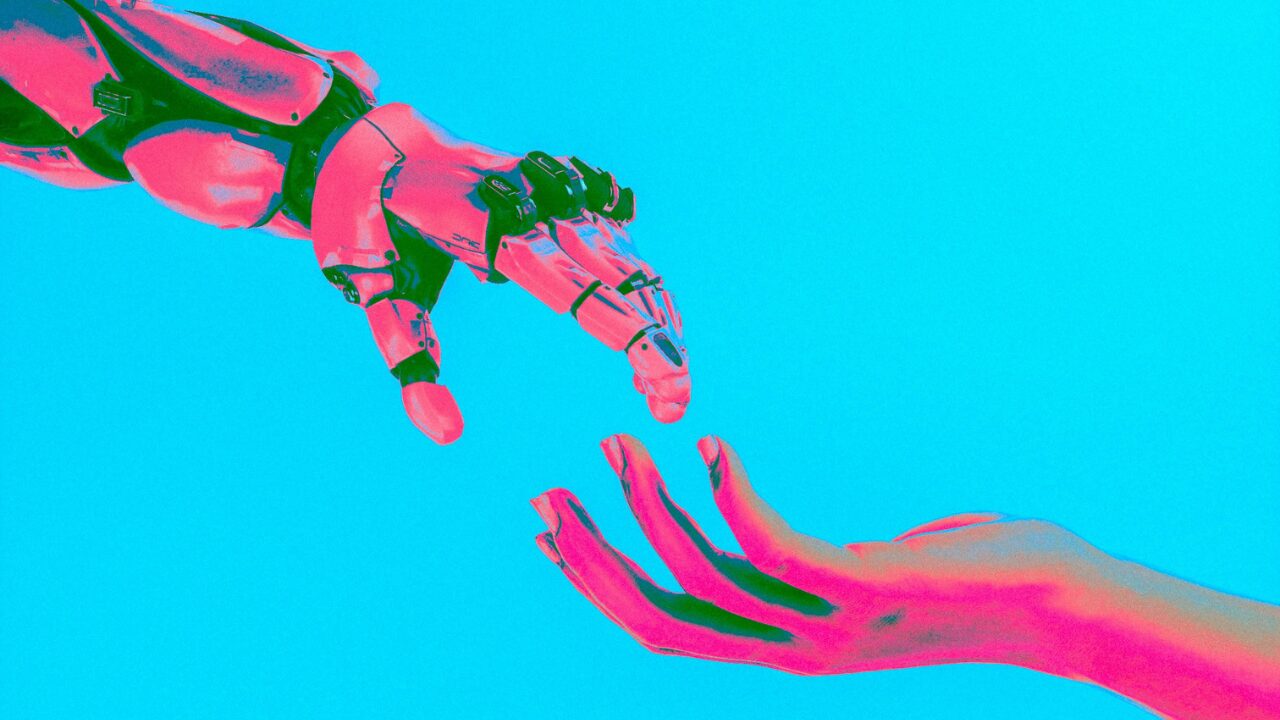

AIがAIを裁く世界の構造的帰結

見落とされがちだが、MetaのプラットフォームにはAI生成コンテンツが急増している。生成AIで作られた広告、AI支援で書かれた投稿、AIが作成した画像。モデレーションの対象となるコンテンツの中でAI生成物の割合は増え続けている。

そこにAIモデレーターが導入されるということは、「AIが作ったコンテンツを、AIが審査する」世界がMetaのプラットフォーム上で実現するということだ。生産者と審査者が同じ企業の開発・運用する技術であり、その両方を同じ企業がコントロールする。外部のファクトチェッカーも外部のモデレーターもいない。この構造が「人間の判断は置き換えない」という言葉と両立するかどうかは、定義の問題ではなく、設計の問題だ。

さらに掘り下げる

シチズンフォー スノーデンの暴露

報道記事・ソース

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。