「同じレッドライン」の文法が違う——OpenAIがペンタゴンに渡した言葉の弾力性

Anthropicが連邦機関から排除された数時間後、OpenAIがペンタゴンとの契約を発表した。CEOアルトマンは「Anthropicと同じレッドラインを共有する」と宣言した。だが両社がペンタゴンに差し出した契約文言を並べると、「同じ原則」が異なる構造を持っていることが見えてくる。

Executive Brief

Contents ——公式発表・一次情報

– Statement on the comments from Secretary of War Pete Hegseth — Anthropic公式声明

Tonight, we reached an agreement with the Department of War to deploy our models in their classified network.

In all of our interactions, the DoW displayed a deep respect for safety and a desire to partner to achieve the best possible outcome.

AI safety and wide distribution of…

— Sam Altman (@sama) February 28, 2026

Summary ——何が起きている?

- OpenAIはペンタゴンの機密ネットワークへのモデル配備で合意し、技術者の常駐を条件に含めた。

- アルトマンは「大規模監視の禁止」と「武力行使における人間の責任」をペンタゴンとの合意原則として提示した。

- Anthropicは「サプライチェーンリスク」指定を「前例のない措置」と批判し、法廷で争う方針を表明した。

- Anthropicは連邦法を根拠に、指定の効力はペンタゴン契約に限定されると主張している。

Perspective ——TECHTECH.の視点

このシリーズの最初の記事で、Anthropic-ペンタゴン対立の本質は「制限の内容」ではなく「解釈権の所在」だと書いた。2本目の記事では、業界の連帯が「倫理的共感」ではなく「先例への恐怖」から生まれた非対称性を指摘した。今回の展開は、その両方の構造を一つの契約書の中に凝縮して見せている。

アルトマンが選んだ2つの単語

アルトマンのXポストを正確に読む。「Two of our most important safety principles are prohibitions on domestic mass surveillance and human responsibility for the use of force, including for autonomous weapon systems」。

一方、Anthropicが維持した条件は、完全自律型兵器——人間の判断を介さずに攻撃を実行するシステム——への利用禁止だった。アモデイは「今日のフロンティアAIモデルは、完全自律型兵器に使えるほど信頼性が高くない」と述べている。この立場を一語に凝縮すれば「oversight(監視・介入)」——システムが動く前に、人間が判断を差し挟む構造だ。

「responsibility」と「oversight」。この2語の差に、今回の契約の構造が集約されている。

OpenAIの「responsibility(責任)」は事後の帰属だ。システムが動いた後に、誰かがその結果を引き受ける。Anthropicの「oversight(監視・介入)」は事前の行為だ。システムが動く前に、人間が判断を差し挟む。事前に止める構造と、事後に引き受ける構造。同じ「人間が関与する」という原則が、時制を変えるだけで全く異なる契約条件になる。

ペンタゴンが拒否したのは「自律型兵器の禁止」という原則ではなかった。「事前に止める権利を民間企業が持つ」という構造だった。OpenAIの「責任」という文言は、この権利を手放している。システムが自律的に動いた後、誰かが責任を取ればよい。誰が、どのように——その定義は契約には書かれていない。

「連帯」から「代替」まで24時間

前回の記事で、アルトマンが社内メモで「Anthropicと同じレッドラインを共有する」と宣言したことを取り上げた。その宣言から24時間以内に、OpenAIはAnthropicが拒否した相手と契約を結んだ。

これを「裏切り」と読むのは表面的だ。アルトマンの行動は一貫している。報道された社内メモによれば、彼は「Anthropicと同じ原則を持つ」と書いた上で、「しかし我々は政府と合意に達することが可能だと信じる」と続けている。同じ原則を持ちながら、異なる文言で合意する——矛盾ではなく、翻訳だ。

アルトマンはさらに踏み込んでいる。「我々は国防省に対し、すべてのAI企業に同じ条件を提示するよう求めている」と述べた。表面的には、これはAnthropicへの救済に見える。だがその「同じ条件」とは、OpenAIが合意した文言——Anthropicが不十分だと判断した文言——に基づいている。Anthropicに差し出されているのは、Anthropicが既に拒否した形式の安全基準だ。

連帯の表明が、代替の布石になっている。しかもその構造は、善意の有無とは無関係に機能する。アルトマンが本心からAnthropicを支持していたとしても、契約の構造が生む結果は同じだ。

Anthropicが法廷に持ち込む「カテゴリの問題」

Anthropicの法的反論にも、このシリーズを通して追ってきた構造が見える。

Anthropicは連邦法10 USC 3252を根拠に、「サプライチェーンリスク」指定の効力はペンタゴン契約に限定され、他の顧客関係には及ばないと主張している。この条文の射程が問題の核心だ。サプライチェーンリスク指定は、物理的な部品の供給元——外国の通信機器メーカーなど——を想定して設計された制度であり、AI企業に適用された前例がない。

前回の記事で、国防生産法(1950年制定)が「工場に戦車の生産を命じる」ための法律であり、AIモデルの安全機能の改変に適用するには制度的空白があると書いた。サプライチェーンリスク指定にも同じ構造が見える。物理的な部品に対して設計された法的ツールを、認知インフラに転用している。Anthropicが法廷で争うのは、自社の排除だけではない。AIが既存の法的カテゴリに押し込められること自体への異議だ。

安全基準の「弾力性」という新しい変数

この一連の対立で見えてきた構造がある。AI安全基準の実効性を決めるのは、基準の「有無」ではなく「弾力性」だということだ。

OpenAIもAnthropicも「大規模監視に反対」「自律型兵器に人間の関与が必要」と言う。原則の水準では区別がつかない。差が生まれるのは、その原則が契約に落とし込まれる段階だ。「oversight」なのか「responsibility」なのか。事前なのか事後なのか。解釈権を保持するのか委譲するのか。

この弾力性は、安全基準というもの自体の機能を変質させる。基準が十分に弾力的であれば、それは制約ではなく修辞になる。原則を掲げていることと、その原則が行動を制約していることは、同義ではない。

第1回で「解釈権の所在」を、第2回で「表明と行動の乖離」を指摘した。今回の展開はその先を示している。解釈権を手放す必要すらない。文言を十分に弾力的にすれば、原則を保持したまま、あらゆる行動が原則の範囲内に収まる。

AI安全の議論は、これまで「何を禁止するか」を中心に進んできた。だが今、問われているのは「禁止の文言がどの程度の弾力性を持つか」だ。そしてその弾力性の程度は、企業間の競争によって決まりつつある。より弾力的な文言を提示した企業が契約を獲得し、硬直的な文言を維持した企業が排除される。安全基準の市場競争が、基準の弾力化を構造的に加速させている。

Drill Down ——もっと掘り下げる

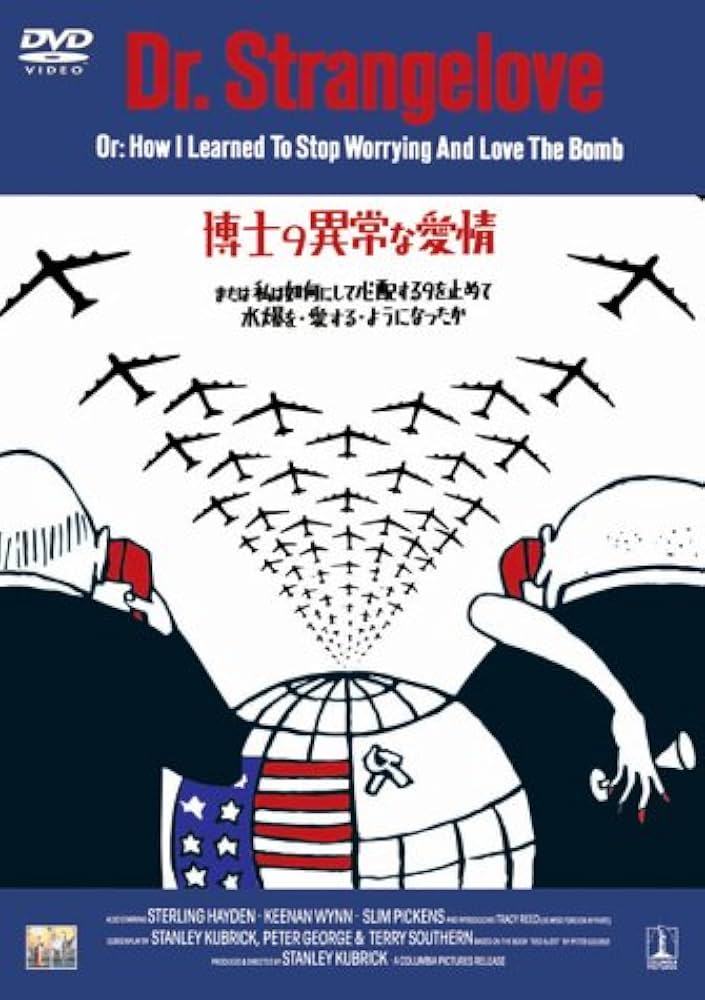

博士の異常な愛情

Context Timeline ——報道記事

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。