2016年の「Elsagate(エルサゲート)」騒動でYouTubeは子ども向けコンテンツの安全対策を強化したはずだった。だが10年後、AI生成ツールの普及が状況を一変させている。The 74とMother Jonesの共同調査は、シートベルトなしで走る車、道路で遊ぶ子どもを映した「教育」動画が、1日50本のペースで量産されている実態を報告した。セサミストリートが20年かけて積み上げた動画数を、AIチャンネルは7ヶ月で超える。

The 74とMother Jonesの共同調査により、YouTubeの子ども向け「教育」チャンネルがAI生成ツールを使い、交通安全を無視した描写や窒息リスクのある食品摂取シーンを含む動画を1日平均50本、7ヶ月で10,000本以上量産していることが明らかになった。

「作る側」に教育的意図がなく、「届ける側」に個別審査の能力がなく、「見る側」に判断力がないという三重の空白が、AI生成コンテンツの最も脆弱な接点で同時に発生していることを示唆している。

セサミストリートが20年で蓄積した約3,900本を7ヶ月で超える生産速度は、プラットフォームの品質審査とアルゴリズム推薦の仕組みが「量」に対応できていない構造的限界を露呈した。

Overview

- 動画編集プラットフォームKapwingの分析では、YouTube全体のフィードの約21%がAI生成の低品質コンテンツで占められている

- シカゴ大学のDana Suskind教授(外科・小児科)はこの状況を「産業規模の幼児向けAI偽情報」と表現した

- NYTの調査では、子ども向けに推薦されたYouTubeショート1,000本超のうち約半数がAI生成の映像を含んでいた

- The 74の報道を受け、YouTubeは7つのチャンネルに対して措置を取り、うち2チャンネルを停止した

品質管理の空白はビジネスモデルが設計したものであり、最も声を上げられない層に集中している

エルサゲートから10年、構造は変わったか

2016年のエルサゲート騒動を覚えているだろうか。エルサやスパイダーマンのコスプレをした人間が不穏な行動をする動画が子どもに推薦され、YouTubeはモデレーション体制を強化した。2019年には子ども視聴者のデータを無断収集していたCOPPA違反で約185億円のFTC和解金を支払い、子ども向けチャンネルの運用ルールも改められた。だが10年経った今、問題の構造は解決されていない。むしろ悪化している。

エルサゲートの時代、問題動画の制作には人間の労力が必要だった。撮影し、編集し、アップロードする。その工程がボトルネックとなり、問題の規模には上限があった。AIがその工程を自動化した今、ボトルネックは消えた。1チャンネルが7ヶ月で10,000本を量産できる世界では、プラットフォーム側の審査能力が追いつかないのは構造的な必然だ。

「リアリスティックでなければラベル不要」という抜け穴

YouTubeのAIコンテンツポリシーには、見落とされがちな設計上の穴がある。AIで作成されたコンテンツに開示ラベルが必要になるのは、そのコンテンツが「リアリスティック」に見える場合に限られる。カラフルなアニメ風の子ども向け動画——まさに今回問題になっているコンテンツの大半——は、この基準を満たさない。

つまり、最もAI生成率が高く、最も判断力のない視聴者に届くコンテンツが、ラベリングの対象外に置かれている。ポリシーの設計意図は「ディープフェイク対策」にあったはずだが、結果として子ども向けコンテンツという最も脆弱な領域が盲点になった。

セサミストリート20年分を7ヶ月で超える意味

テンプル大学教授でブルッキングス研究所シニアフェローのKathy Hirsh-Pasekは「怪物的な問題の始まりにいる」と警告する。この「怪物」の正体は、コンテンツの質ではなく量にある。

セサミストリートの3,900本は、児童発達の専門家、教育者、脚本家が20年かけて積み上げたものだ。一方、AI生成チャンネルの10,000本は、教育的知見を持たない運営者が収益化を目的に量産したものだ。質の違いは明白だが、YouTubeのアルゴリズムは両者を同じ「子ども向け教育コンテンツ」として扱う。昨日配信した記事で「AI slop」の拒絶構造を取り上げたが、ゲーマーには「拒絶する」選択肢があった。3歳児にはない。

品質管理の空白地帯は「設計」されている

The 74の報道を受けてYouTubeが措置を取ったのは7チャンネルだった。うち停止は2つ。この数字が示しているのは、報道がなければ措置は取られなかったということだ。プラットフォームの自浄作用は、外部からの告発に依存している。

以前取り上げたAIおもちゃの調査では、物理的安全基準はあっても「心理的安全性」の基準がないことが問題だった。YouTube上のAI教育動画にも同じ構造がある。「有害コンテンツの除去」という事後対応の仕組みはあるが、「教育コンテンツの品質担保」という事前の仕組みは存在しない。品質管理の不在は事故ではなく、プラットフォームのビジネスモデルが生んだ構造的な帰結だ。

考える問い

- 子どもにYouTubeを見せるとき、推薦されたコンテンツの何割がAI生成であるか、判別する手段を持っているか。

- セサミストリートのような専門家が設計した教育コンテンツと、AIが量産した「教育風」コンテンツを、3歳児の視聴体験として同列に扱うアルゴリズムは適切か。

- プラットフォームの品質管理が外部の調査報道に依存している状態を、利用者として許容できるか。

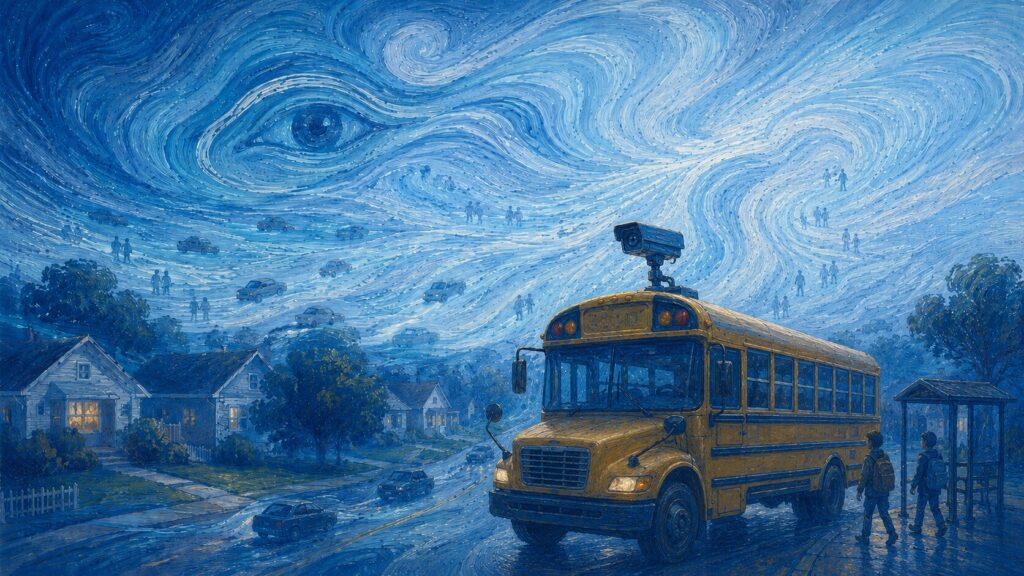

BusPatrol

BusPatrol

OpenAI

OpenAI