資料を納品したら「これ、AIで作りましたよね」と返された。自分で書いたのにその発言がなぜできるのか。身に覚えがある人は増えているはずで、反論しようとして気がつく。「あれ、使っていないことの証明は、どこまで遡ってもできないではないか」と。

学術、著作権、報道、採用——複数の領域で同時に「人間であることの証明」が求められ始めている。この構造変化を読み解き、今我々がなにを思考して、判断して、行動していけばよいか考察してみる。

AI検出ツールの誤判定、著作権登録でのAI使用開示義務、報道現場での撮影証明要求が、学術・法律・ジャーナリズムの各領域で同時に広がっている。

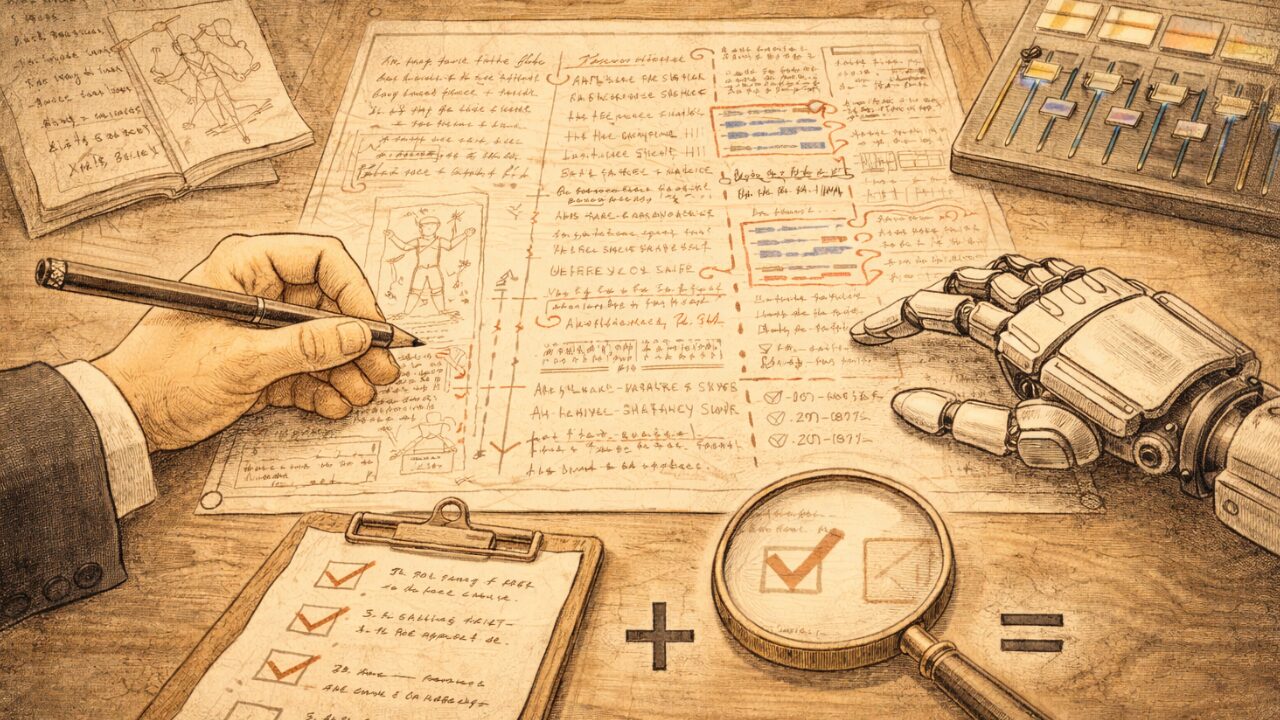

証明の方向は「不使用の否定」から「人間が関与した過程の記録」という積極的事実へ転換しつつある。

「AIを使っていない」という消極的事実の証明が困難なため、立証責任が作り手側に移り、プロセスの記録という新たなコストが発生している。

「AIを使っていない」は証明できないため、問い自体を変えるしかない

悪魔の証明が日常になった

法律の世界に「悪魔の証明」という概念がある。「存在しないこと」の証明。ある事実が「なかった」ことを完全に立証するのは原理的に不可能に近い。例えば、あなたが「昨日、スマホを一切使わなかったことを証明して」と言われたら、何が客観的に信じられる証拠になるだろうか。

そのため近代の法制度は、立証責任を「主張する側」に置いた。これは「何かがあった」と言うならあった側が証拠を出すということ。

例えば「この文章はAIで書いたのではないか」と問われたとき、書き手が証明しなければならないのは「使わなかった」という消極的事実となる。使ったことの証拠は、検出ツールやメタデータから探せるが「使わなかった」ことには、提出できる証拠がほぼない。

下書きのメモを見せても、そのメモをAIで生成していないとどう証明するのか。思考プロセスを説明しても、それは事後的に構成できる。どこまで遡っても証明は完了しない。

これがひとつの領域だけで起きているなら個別の問題として扱えるが、今、複数の領域で同時に発生しているのだ。

4つの領域で同じ構造が動いている

教育。 スタンフォード大学の研究チームが7つのAI検出ツールを検証した結果、TOEFL(英語能力試験)の小論文の61.3%がAI生成と誤判定された。すべて人間が書いたものにもかかわらず、検出ツールによっては97.8%にフラグが付いた。検出ツールは文章の「複雑さ」を指標にしており、平易な文章を「機械的」と判定してしまう。Cornellをはじめ米国の複数の主要大学が、AI検出ツールの使用を非推奨に転換している。

著作権。3月2日、米最高裁がThaler対Perlmutter訴訟の上告を棄却した。これはAIが単独で生成した作品に著作権は認められないということ。この判決については1ヶ月前にも取り上げたが、あの記事で指摘したのは「最高裁が決めなかったこと」のほうだった。人間がAIを道具として使った場合の著作権はどうなるのか、と。

その問いに対して、米著作権局が実務的な回答を出し始めている。AI使用の開示義務。人間の創作的寄与の説明。プロンプトだけでは著作権は発生しない——著作権局はそれを「サイコロの振り直し」と呼んだ。

では何が必要なのか。それは「使っていない」ことの証明ではなく、「人間がどう関与したか」という創作プロセスの記録(積極的事実)の文書化である。

報道。フォトジャーナリズムの現場では、C2PA(Coalition for Content Provenance and Authenticity)という規格が普及し始めている。撮影した瞬間にカメラが暗号署名を画像に埋め込む技術。SamsungのGalaxy S25、GoogleのPixel 10、NikonのZ6 IIIなどが対応。報道機関はカメラマンにRAWファイルと撮影シーケンスの提出を求めるようになってきているようだ。

写真が「本物か」を事後に検証するのではなく、撮影の瞬間に「本物である」ことを刻印する。消極的事実(加工していない)から積極的事実(撮影時点の証明がある)への転換である。

採用。MetaやCanva、Googleは技術面接でのAI使用を許可し、「AIを使ったかどうか」ではなく「AIで出したコードを説明できるか」で評価する方針に転換している。Canvaのプラットフォーム責任者は「AIの使用を求める」と明言している一方で、AI使用を禁止する企業は検出不可能な不正に悩んでいる。禁止と許可の二極化が進んでいる。

消極的事実から積極的事実への転換

4つの領域に共通することを整理すると「AIを使っていない」は消極的事実——ないことの証明だ。悪魔の証明に限りなく近く、原理的に証明は完了しない。AI検出ツールはこの証明を外部から試みているが、誤判定のリスクがあり、証明ツールとしては信頼できない。

そして、この行き詰まりに対抗するために、別のアプローチが現れている。

著作権局は「プロセスの文書化」を求め、C2PAは「撮影時点の暗号署名」を埋め込み、Metaは「コードの説明能力」を評価基準にしている。方向はそれぞれ違うが構造は同じ。「使っていない」ことの証明(消極的事実)を諦め、「人間がどう関与したか」の記録(積極的事実)に軸足を移している。

例えば、ソフトウェア開発においてバグが「ない」ことを証明するのはほぼ不可能だ。だからこそテストを行い、テストが通ったという積極的事実を積み重ねることで品質を担保する。バグがゼロだとは誰も言わないが「ここまでは検証した」という記録があれば信頼の基盤になる。

そう、どれだけ信頼できるかを積み上げて、「信頼できない」を薄めていく作業をするということ。

これと同じ構造が人間の創作活動にも持ち込まれていると思う。思考メモ、下書きの変遷、編集プロセスの記録。「AIを使っていない」と主張するのではなく、「人間がここに関与した」と示す。証明の方向が反転しているのではないだろうか。

問いの立て方を変えていくしかない

プロセスの記録は、大企業や法務チームを持つ組織には実行可能になる。文書化のコストを負担できるのはリソースのある側。フリーランスのイラストレーターが1枚の絵に対して「制作過程のエビデンス」を残す負担は、作品そのものを作るコストに匹敵するかもしれない。

AI検出ツールの偽陽性問題は、さらに根が深い。スタンフォード大学の研究が示したのは、「文章が単純だからAI製と判定される」という。非ネイティブの英語話者、学習障害のある学生が、同じ文章を書いても高い確率でフラグされる。立証責任の反転は、すでに不均衡な場所でより重くのしかかっている。

映画『ブレードランナー』では、フォークト=カンプフ検査(感情反応を測定するテスト)で人間とレプリカントを見分けた。だがあの映画が最後に突きつけたのは、テストが信頼できなくなったらどうするか、という問いだった。AI検出ツールの誤判定率を見ていると、フィクションが先に到着した場所に現実が追いついてきたようにも思える。

ひとつだけ言えるのは、「使ったか使っていないか」という問いの立て方自体が、もう機能しなくなりつつあるということだ。問い自体を切り替えるしかないと思う。「何を使ったか」ではなく「あなたはそこで何を考え、何を判断したのか」。証明すべきはAIの不在ではなく、思考の存在のほうだ。

その思考は、本当にあるか

ただし、この転換には前提がある。「何を考え、何を判断したか」で評価するなら、人間が実際に考え、判断していなければ成り立たない。その前提がすでに怪しい気もしている。

以前取り上げたArs Technicaの事件では、AI専門記者がAIの生成した捏造引用をそのまま記事に載せていた。AIの仕組みを誰より知っているはずの人間が、出力の流暢さに騙された。Anthropicが約1万件のClaude会話を分析した研究でも、出力の完成度が高いほどユーザーの検証頻度が低下することが確認されている。AIが上手くなるほど人間は鈍くなっていくことがわかってきている。

そして、この傾向は個人の怠慢では片づけられない。カーネギーメロン大学とMicrosoftの共同研究は、AIへの信頼度と批判的思考が逆相関する構造を示した。教室ではそれが先に可視化されていて、UC Berkeleyの教授陣は「読めない、分析できない、データを統合できない」学生の出現を報告している。教室で起きていることが職場で起きないとは言い切れない。

AIを使ったか使わなかったかではなく、AIの出力のどこで自分の判断を挟んだか。Amazonがシニアエンジニアによる承認制を導入したのは、この問いへの組織的な回答だった。AI利用率80%という目標がシステム障害を連発し、人間の判断を挟む仕組みを制度として作らざるを得なくなった。

使うか使わないかの二択は、もう機能しないと思う。AIとどう役割を分担するか——出力のどこに人間が介入し、何を検証し、何を判断するか——を意識的に設計すること。それが、思考の存在を示す最も実効的な方法になりつつあると思う。

そしてそれは「AIを使っていないか?」と問う側にもそのスタンスが必要になってくるのではないか。

考える問い

- あなたが仕事で作った資料に「AIで作りましたか」と聞かれたら、どうやって「違う」と証明するか。その証明にかかるコストを想像したことはあるか

- AI検出ツールの偽陽性で不利益を被るのは、なぜ「文章が単純な人」——非ネイティブ、学習障害のある学生——に偏るのか。この構造は是正可能か

- 「プロセスを記録する」という解決策は、記録のコストを負担できる側に有利に働かないか。立証責任の反転が生む新たな格差はどこに現れるか

- 「AIを使ったか使わないか」ではなく「何を考えて判断したか」を問う社会に移行するとき、評価の仕組みはどう変わるべきか

- 報道写真のC2PAのように「作った瞬間に証明を埋め込む」技術が創作全般に広がったとき、暗号署名のない作品は信頼されなくなるか

報道記事・ソース

- Really, you made this without AI? Prove it

- GPT detectors are biased against non-native English writers

- Supreme Court Denies Certiorari in Thaler v. Perlmutter

- Canva now insists job candidates use AI during actual interviews

- How to use AI in Meta's AI-assisted coding interview

- C2PA in 2026: Does the Content Provenance Standard Actually Work?

- Content Credentials (C2PA) for Photographers: Should You Turn It On or Skip It?

- How Do Professors Detect AI in 2026? Tools, Accuracy, and False Positives

Anthropic

Anthropic Claude

Claude

BusPatrol

BusPatrol