できるようになること

30分後:

- NotebookLMに自分のSNSデータを投入し、Check(傾向分析)→ Act(改善方針の決定)→ Plan(次の施策設計)を1回転させている。

- 「何が効いていて、何が効いていないか」が、データだけに基づいて判断できた状態。

その先:

- 新しい投稿データを追加するたびに、同じ手順でPDCAサイクルを回せる。

- SNS運用に限らず、「自分のデータだけで判断したい」あらゆる分析に使い回せる環境が手元にある。

なぜNotebookLMなのか

NotebookLMには構造的な特性がある。投入したソース以外の情報を使わない。

ChatGPTやClaudeに同じデータを渡しても、学習データの知識が回答に混ざる。「一般的にはリール投稿が効果的です」のような、自分のデータとは関係のない情報が出てくる。NotebookLMではそれが起きない。返ってくるのは、自分のデータだけを根拠にした回答だ。

さらに、出力のたびに「どのソースを参照したか」が明示される。回答に使われた根拠を自分で確認できる。ソース外の情報が混ざった場合はその旨が表示されるため、ハルシネーションの判別もしやすい。

余計な知識の遮断 = 判断のノイズ除去。PDCAのCheckでは、一般論ではなく自分のデータだけで判断することに意味がある。

最終アウトプット

この記事で完成するのは、NotebookLMのノートブック1つ。

中身は、プロジェクト概要ドキュメント + 1週間分の投稿データ(5投稿分)+ Check→Act→Planの会話履歴。新しいデータを追加するたびにPDCAサイクルを継続できる基盤になる。

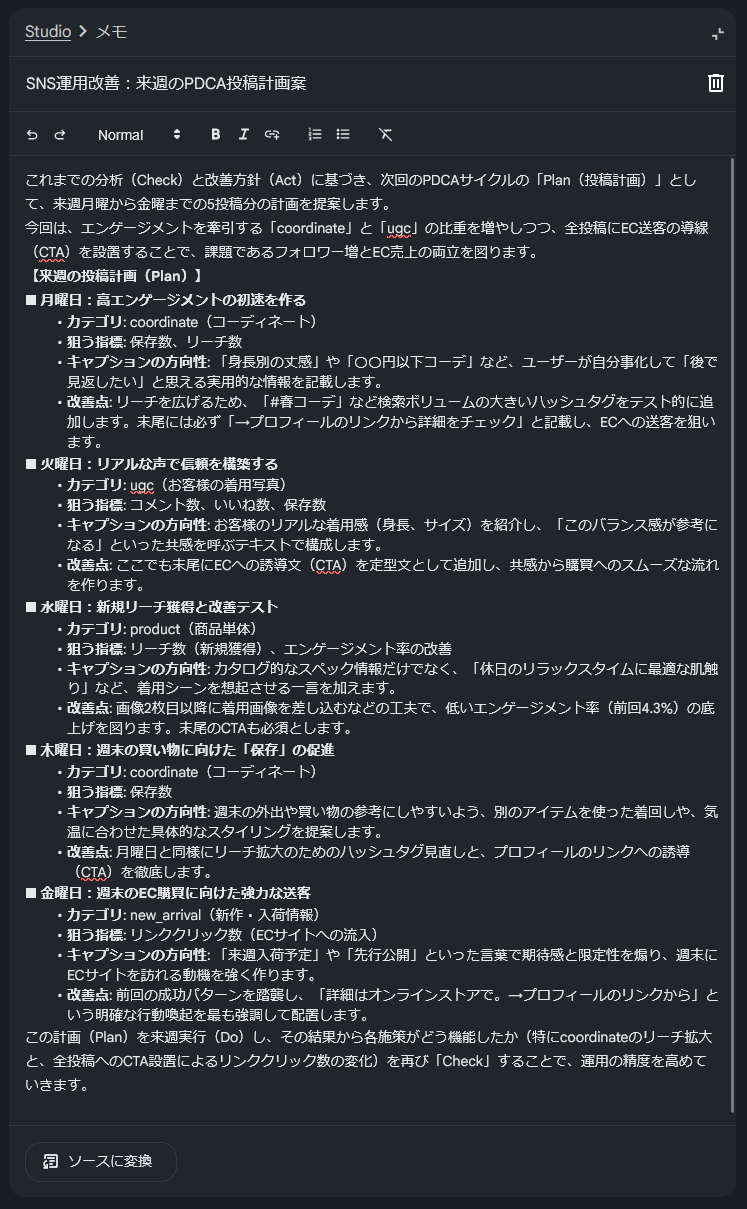

以下が、NotebookLMが出力した「来週の投稿計画」の一部だ。

月曜日:coordinate(コーディネート)

狙う指標: 保存数、リーチ数

キャプションの方向性: 「身長別の丈感」や「〇〇円以下コーデ」など、ユーザーが自分事化して「後で見返したい」と思える実用的な情報を記載。

改善点: リーチを広げるため、検索ボリュームの大きいハッシュタグをテスト的に追加。

次に投稿する5投稿分の計画が、データ上の根拠とともに出力される。この粒度の分析と施策提案が、30分で手に入る。

結論

「自分のデータだけで判断したい場面」にNotebookLMは最適な選択肢になる。PDCAのCheckフェーズがまさにそれだ。

向いている人:

- データはあるが、分析の仕方がわからない人

- 一般論ではなく自分の状況に基づいた判断がしたい人

- 分析ツールに課金したくない人

- 一人か少人数でSNSを回していて、壁打ち相手がいない人。

向いていない人:

- まだデータが十分にない段階の人(投稿10件未満など)

- 幅広い知識ベースでアイデア出しや壁打ちをしたい場合は、ChatGPTやClaudeのほうが適任(NotebookLMは「知識が広いAI」ではなく「知識を絞ったAI」であり、その制約こそが強みになる。)

以下のセクションで、実際にNotebookLMを使ってPDCAを回す全工程を再現する。

具体的な使用方法と手順

今回は、架空のアパレルD2Cブランド「TECHTECH.」のInstagram運用を例に、NotebookLMでPDCAのCheck→Act→Planを1サイクル回す。

前提:

- TECHTECH. はユニセックスのベーシックウェアを扱う小規模D2Cブランド(運営2名)

- Instagramフォロワー約1,200人、週5回投稿

- 課題: フォロワー数が横ばい、エンゲージメント率が低下傾向、「何が効いているか」がわからない

- 1サイクル = 1週間(5投稿)

全体の流れ:

- プロジェクト概要の作成と投入

- 投稿データの投入

- Check — データ分析(3段階の質問)

- Act — 改善方針の決定

- Plan — 次週の投稿計画

- Studio — 分析結果の視覚化と報告資料の作成

工程1〜5で約30分。工程6まで含めると約45分。

プロジェクト概要の作成と投入

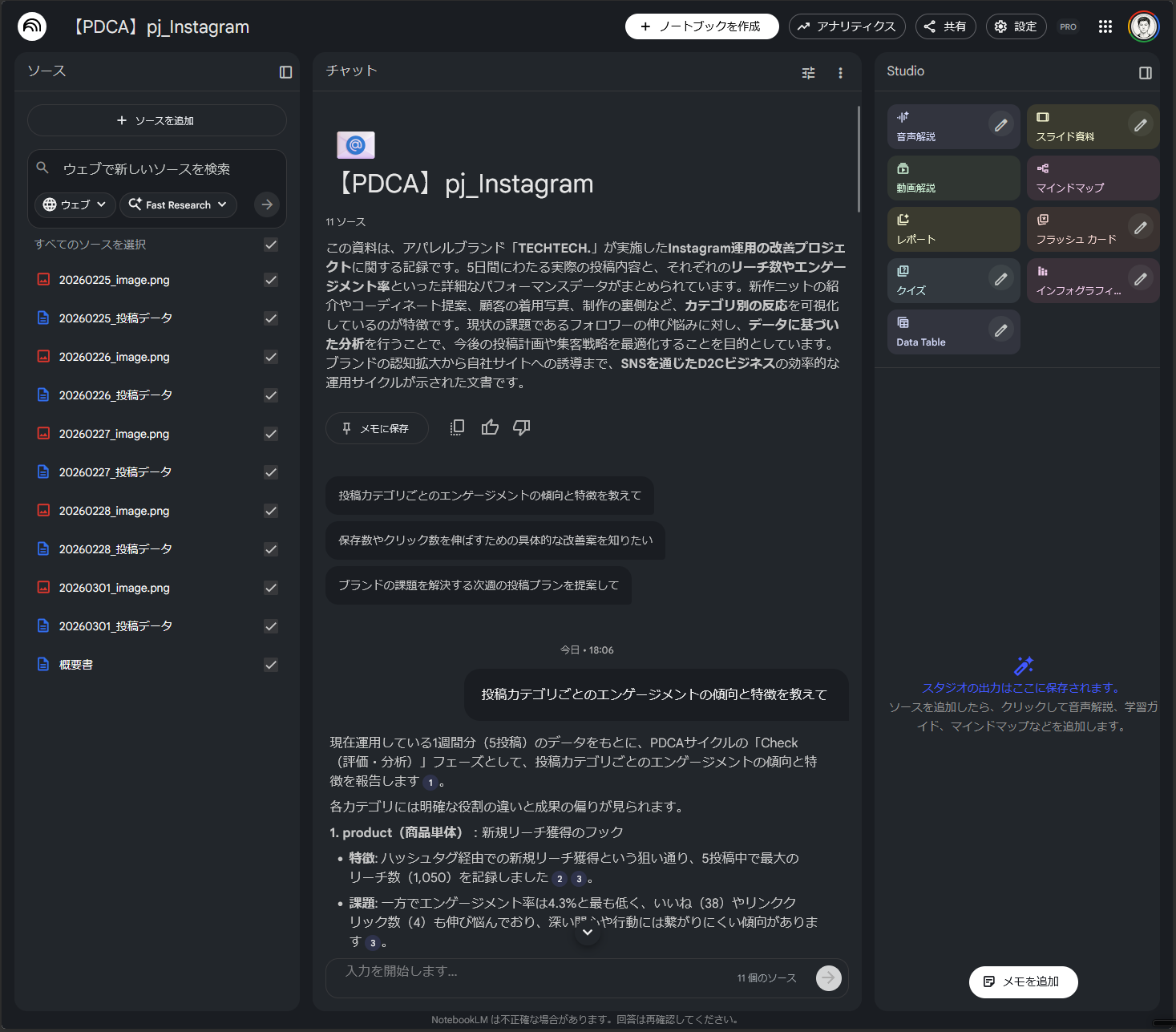

まずは、NotebookLMにノートブックを新規作成し、プロジェクト概要ドキュメントを投入する。

このドキュメントがNotebookLMの「前提知識」になる。投稿データだけを入れても分析はできるが、概要書があるとNotebookLMの判断基準が安定する。

今回、投稿データにはカテゴリ名(product、coordinateなど)を明記していない。だが概要書にカテゴリ定義を書いておいたところ、NotebookLMはキャプションの内容から各投稿のカテゴリを正しく分類できた。概要書がないと、この分類はできない。

概要書に含めたほうがよい内容:

- ブランド概要(業態、運営体制、商品ジャンル、価格帯)

- Instagramアカウントの現状(フォロワー数、投稿頻度、アカウントの役割)

- 投稿カテゴリの定義と各カテゴリの狙い

- 現在の課題

- 分析の目的(このプロジェクトで明らかにしたいこと)

- 評価指標の定義

- PDCAの運用ルール(1サイクル = 何投稿か、各フェーズの役割)

概要書の作成は、ChatGPTやClaude、GeminiなどのAIと行っても良い。

この際、AIに言ってくることを鵜呑みにせず、本当に達成したい目的・ゴール、そして現在抱えている課題をなぐり書きでもよいのでAIに渡して、それをドキュメントに整理してもらう、という使い方がおすすめ。

期待される結果:

NotebookLMがソースを読み込み、自動でサマリーを生成する。サマリーの内容を確認し、ブランドの立ち位置や課題が正しく認識されていれば成功。

注意点:

- 概要書は「ガチガチに固めすぎない」ことが重要。制約が多すぎると、NotebookLMの出力が画一的になり、分析の柔軟性が失われる。目的と評価指標を明確にしつつ、分析の方向性には余白を残す

- このドキュメントは毎サイクル使い回す。一度作れば、次回以降は投稿データの追加だけで済む

投稿データの投入

次に、1週間分(5投稿分)のデータをNotebookLMに投入する。Instagramの場合、各投稿のインサイト画面からいいね数・保存数・リーチ数などを確認できる。それをテキストファイルに転記するか、インサイトのエクスポート機能を使ってNotebookLMに投入する。

実際に使ってみて感じたポイントは、1投稿 = 1ファイルにすること。画像は画像ファイルのまま入れて、テキストは1ファイルにしてキャプション全文・パフォーマンスデータをまとめる。

ファイル構成の例:

投稿日: 2026-02-23(月)

## キャプション

春の新作ニット。

やわらかい肌触りと、肩の落ち方にこだわった。

着るとわかるシルエット。素材:コットン70% / ナイロン30%

カラー:アイボリー / チャコール / モカ

価格:¥8,800(tax in)#TECHTECH #ニット #春ニット ...

## パフォーマンスデータ

| 指標 | 値 |

|------|------|

| いいね数 | 38 |

| コメント数 | 2 |

| 保存数 | 4 |

| シェア数 | 1 |

| リーチ数 | 1,050 |

| エンゲージメント率 | 4.3% |

キャプションとデータを別ファイルにすると、NotebookLMが参照するソースの組み合わせにズレが生じることがある。同じファイルにまとめたほうが分析の精度が安定する。

また、日付の扱いや命名は重要だ。テキストファイルに投稿した日付を入れたり、画像ファイルとテキストファイルを同じ日付で対応させてあげること。これがないと人間もAIもどの投稿かがわからなくなってしまう。

画像ファイルもソースに入れる:

画像は「png」や「jpg」にも対応。NotebookLMが画像の内容を解析して答えてくれるため、画像を使ったクリエイティブの場合は推奨だ。

今回NotebookLMに入れた画像は以下の通り。

注意点:

- 画像のアップロードに失敗することがある。今回、UGC投稿用の画像(人物のミラーセルフィー)がNotebookLMのコンテンツポリシーに引っかかり、アップロードできなかった。人物が大きく写っている画像は弾かれる可能性がある。その場合は、画像を差し替えるか、画像の内容をテキストで記述して投入すれば対応できる

- NotebookLMのソース上限は300件。長期運用では、過去のPDCAサイクルのデータを「総括ドキュメント」として1つにまとめ、詳細データは直近サイクル分だけ残す運用が現実的だ

Check ――データ分析と傾向発見

ソースの入力が完了したら、実際にNotebookLMを使って3段階の質問で、段階的に分析を深める。全体俯瞰→比較分析→深掘りの順に進める。

質問1:全体俯瞰

使用プロンプト:

投稿カテゴリごとのエンゲージメントの傾向と特徴を教えて

期待される結果:

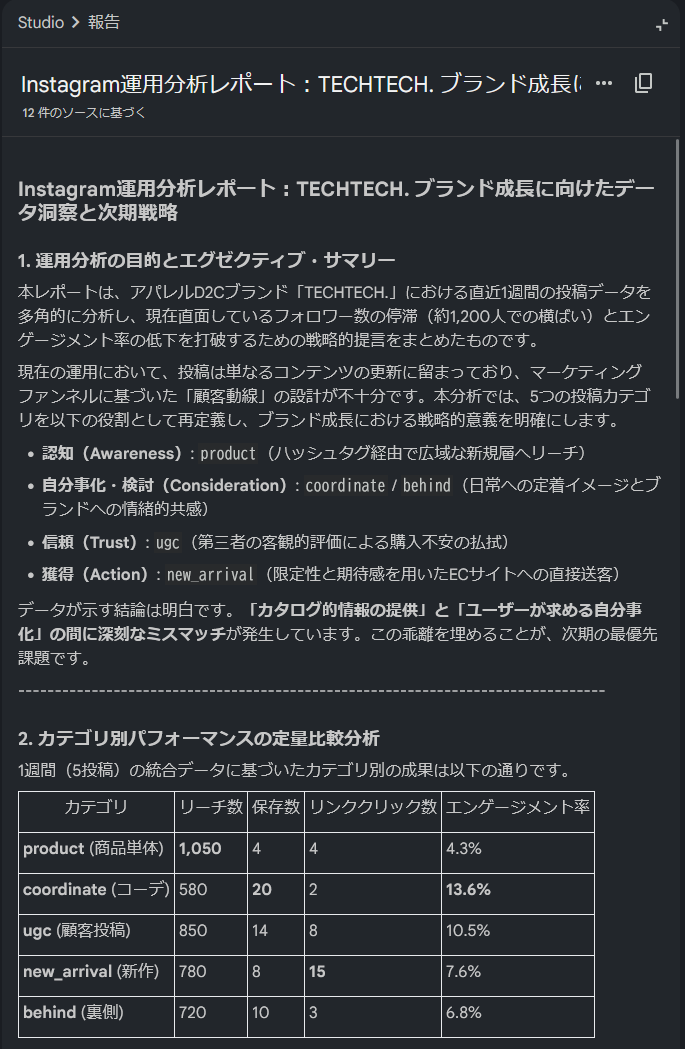

各カテゴリの特性が整理される。今回のデータでは以下の傾向が出力された。

- product(商品単体):リーチ数1,050で最大だが、エンゲージメント率4.3%で最低。広く届くが浅い

- coordinate(コーディネート):エンゲージメント率13.6%で最高、保存数20で突出。深く刺さるがリーチは580で限定的

- ugc(着用レビュー):コメント数9、シェア数5で最多。双方向の反応が活発

- new_arrival(入荷情報):プロフィールアクセス28、リンククリック15でEC導線として最強

- behind(裏側):全指標が中程度。突出した強みがない

NotebookLMは自発的に「productで広く集め、coordinateで保存を稼ぎ、new_arrivalでECへ送客する」という導線の示唆まで出力した。概要書に課題とゴールを書いておいたことで、単なるデータの羅列ではなく、目的に沿った分析になっている。

質問2:比較分析

使用プロンプト:

エンゲージメント率が高い投稿と低い投稿を比較してください。何が違いますか? キャプションの内容、画像の特徴、投稿カテゴリの観点から分析してください。

期待される結果:

高エンゲージメントと低エンゲージメントの投稿の違いが、キャプション・画像・カテゴリの3軸で整理される。

今回の出力で注目すべき点:

- キャプションの違い:高エンゲージメント投稿は「休日コーデ」「全部1万円以下で揃う」のような利用シーンと実用情報を含む。低エンゲージメント投稿(product)はスペック情報とEC誘導が中心で、カタログ的

- 画像の違い:高エンゲージメント投稿は着用写真(シルエットやサイズ感が見える)。低エンゲージメント投稿は商品単体の置き撮り。NotebookLMは画像の内容まで読み取って比較している

- 示唆:「ユーザーは自分が着用したときのリアルなイメージに対して高くエンゲージメントする」

画像の内容まで分析に含めてくるのは想定以上だった。テキストデータだけでなく、投稿画像もソースに含める価値がある。

質問3:深掘り

使用プロンプト:

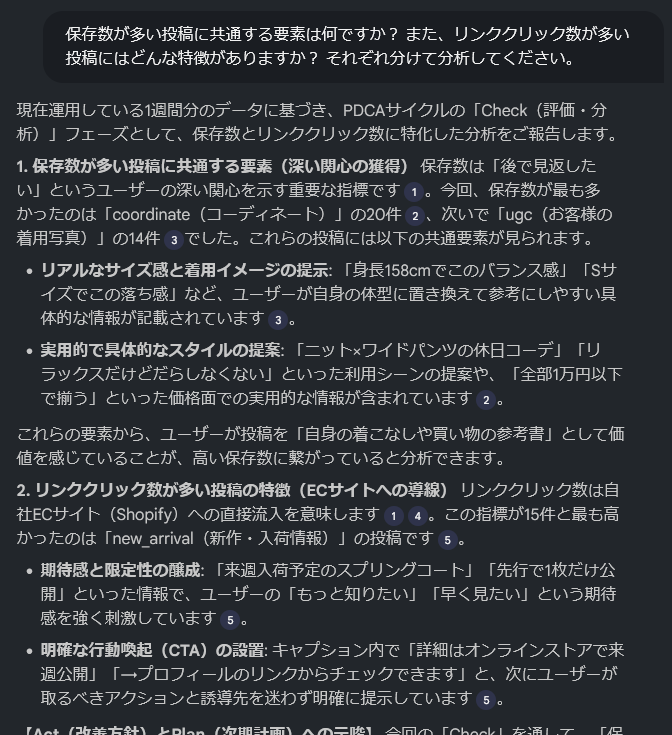

保存数が多い投稿に共通する要素は何ですか? また、リンククリック数が多い投稿にはどんな特徴がありますか? それぞれ分けて分析してください。

期待される結果:

「保存」と「クリック」を促すトリガーがそれぞれ異なることが明確になる。

- 保存を促す要素:身長・サイズ感などリアルな着用情報、具体的なコーディネート提案、価格帯の明示。「後で見返す参考書」としての価値

- クリックを促す要素:「来週入荷予定」「先行で1枚だけ公開」のような期待感と限定性。「→プロフィールのリンクからチェックできます」のような明確なCTA(行動喚起)

この分析によって、「保存(深い関心)を稼ぐ投稿」と「クリック(EC送客)を稼ぐ投稿」は別物であり、それぞれに効くキャプションの書き方が違うことが構造的に見えてくる。

Check全体の注意点:

- 出力には1回あたり2〜3分かかる。ChatGPTやClaudeの即時応答に慣れている場合は、待ち時間に感じるかもしれない

- 同じ質問でも、ソースの構成(1投稿1ファイルか、複数投稿を1ファイルにまとめるか)で回答の精度が変わる。データの粒度はソースの構造に影響する

Action ――改善方針の決定

Checkの結果を踏まえ、NotebookLMに改善方針を提案させる。その提案に対して、人間が判断を下す。もちろん議論をしたり、質問をしたりするのもありだ。

使用プロンプト:

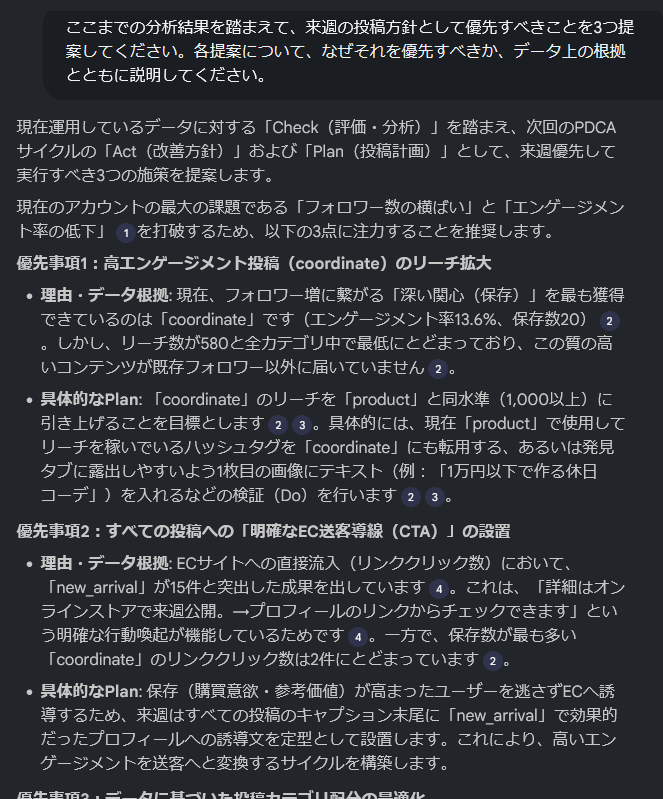

ここまでの分析結果を踏まえて、来週の投稿方針として優先すべきことを3つ提案してください。各提案について、なぜそれを優先すべきか、データ上の根拠とともに説明してください。

期待される結果:

データに基づいた改善方針が3つ提示される。

- 高エンゲージメント投稿(coordinate)のリーチ拡大:エンゲージメント13.6%・保存数20だが、リーチ580で既存フォロワー止まり。ハッシュタグの見直しや発見タブへの露出施策を提案

- 全投稿への明確なEC送客導線(CTA)の設置:new_arrivalのリンククリック15件はCTAの明確さが要因。coordinateの保存数は高いがリンククリック2件で、送客に転換できていない

- 投稿カテゴリ配分の最適化:coordinateとugcのエンゲージメントが高い実証データに基づき、感覚的な配分からデータに基づいた配分へ移行

ここが最も重要な工程だ。

NotebookLMの出力は「もっともらしい」。データの参照も正確で、論理も通っている。だからこそ、人間側に判断の軸がないと、提案をすべて鵜呑みにしてしまう。

たとえば提案1の「coordinateのリーチ拡大」。方向性は正しいが、「発見タブへの露出施策」を2名体制のブランドが実行できるかは別の話だ。NotebookLMは実行可能性を知らない。リソースの制約、ブランドのトーン、今月の優先事項——それを判断できるのは人間だけだ。

事前に決めておくべきこと:

判断の軸(ゴール・優先指標・リソース制約)は、NotebookLMを開く前にFIXさせておく。軸がブレると、もっともらしい提案に引きずられて方向性が変わる。

注意点:

- NotebookLMの出力は「壁打ち相手の意見」であって「正解」ではない。どの提案を採用し、どれを却下するかは人間が決める。この判断プロセスを省略しないこと

- NotebookLMは目的や課題から優先事項を分析して提案できる。一人でPDCAを回している人間にとって、これは「孤独じゃない」と感じられる瞬間でもある。ただし、心地よいからといって批判的思考を手放さないこと

Plan ――次週の投稿計画

採用した改善方針に基づき、次の1週間の投稿計画を設計させる。

使用プロンプト:

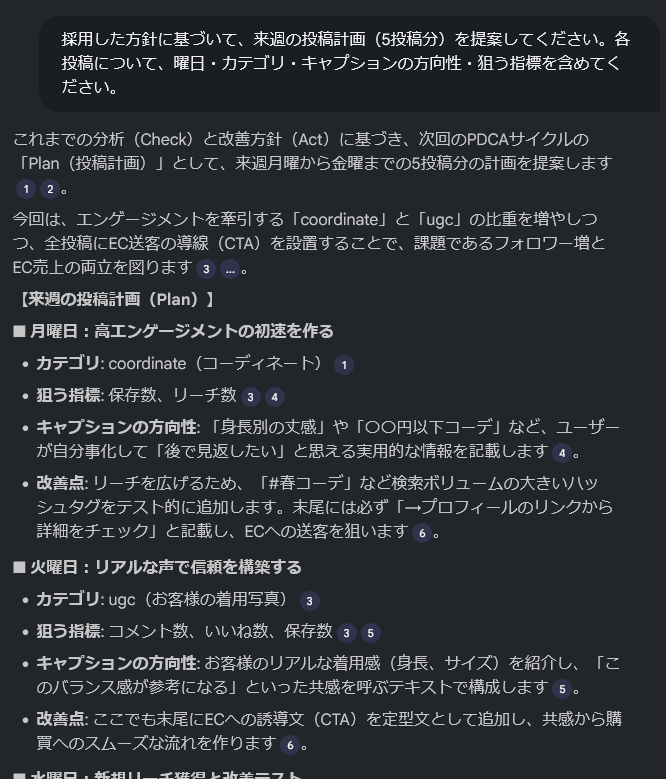

採用した方針に基づいて、来週の投稿計画(5投稿分)を提案してください。各投稿について、曜日・カテゴリ・キャプションの方向性・狙う指標を含めてください。

期待される結果:

曜日ごとのカテゴリ、狙う指標、キャプションの方向性、前回からの改善点を含む5投稿分の計画が出力される。

- 月曜日: coordinate――狙う指標: 保存数、リーチ数。「身長別の丈感」「〇〇円以下コーデ」など実用情報を記載。リーチ拡大のため検索ボリュームの大きいハッシュタグを追加。末尾にEC誘導のCTAを設置。

- 火曜日: ugc――狙う指標: コメント数、保存数。お客様のリアルな着用感を紹介。CTAを定型文として追加。

- 水曜日: product――狙う指標: リーチ数、ER改善。スペック情報だけでなく着用シーンを想起させる一言を追加。2枚目以降に着用画像を差し込む改善テスト。

前回のデータ分析の結果が、具体的な施策に落とし込まれている。「coordinateの週2回投稿」「全投稿へのCTA設置」「productのキャプション改善」など、Checkの発見がそのままPlanに反映されている構造が見える。

注意点:

- この計画はあくまで「下書き」。人間が最終調整して確定する。NotebookLMは投稿の実制作(画像撮影、キャプション執筆)はできない。DoフェーズはNotebookLMの外で行う

- 確定した計画は、テキストにまとめてNotebookLMのソースに追加しておく。次のサイクルで「前回の計画と結果を比較して分析してください」と聞けば、サイクルが接続される

分析結果の視覚化と報告資料の作成

NotebookLMのStudio機能を使い、ここまでの分析結果と次回計画を視覚化・資料化する。

AIチャットで分析と計画が完了した段階で、NotebookLMの役割は「考える」から「伝える」に移る。Studio機能を使えば、ソースとチャットの内容を元にした報告資料が、同じノートブック内で完結する。

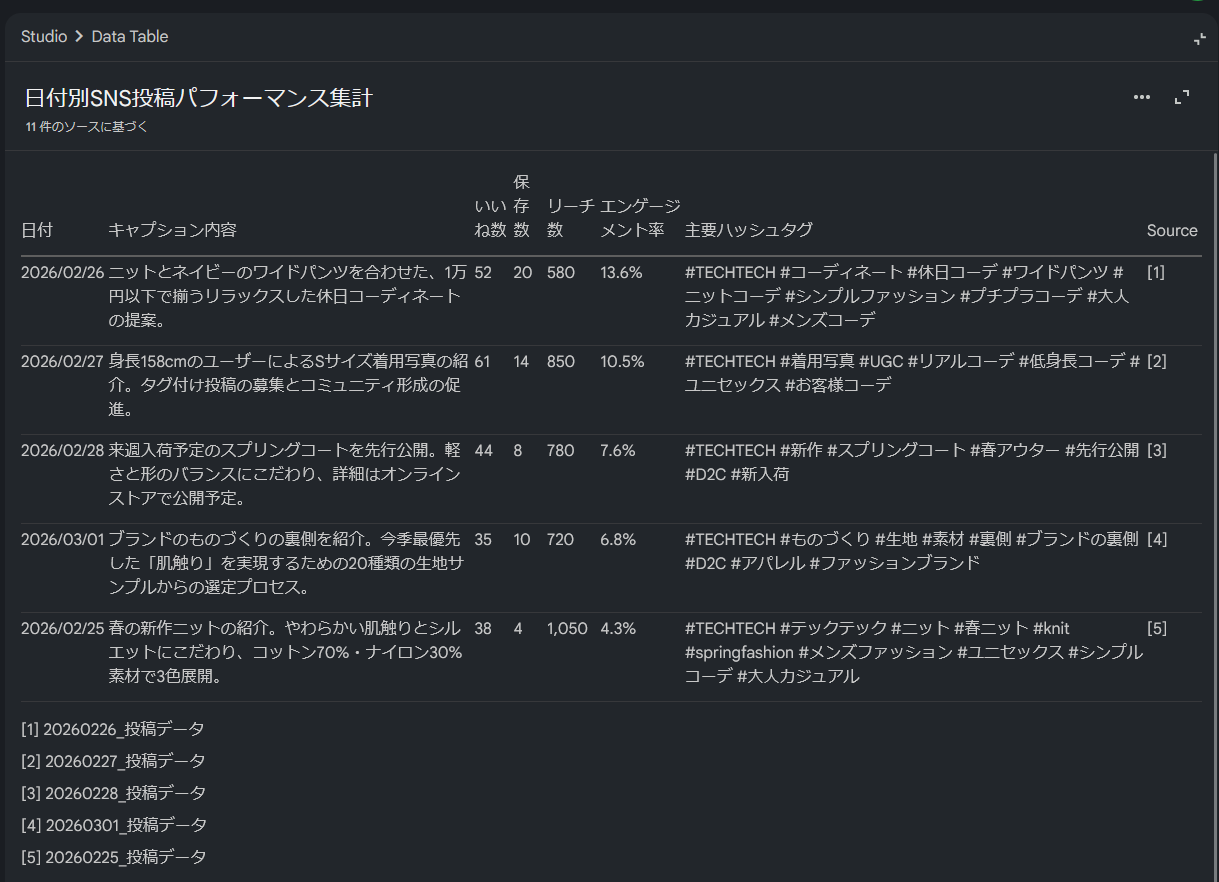

Data Tableでデータを一覧化する

個別のソースとして投入した5投稿分のパフォーマンスデータを、1つの表に集約できる。カテゴリ・日付・各指標を並べて比較すると、チャットでの分析で見えた傾向が数字の一覧として確認できる。

バラバラのファイルに入っていたデータが、自動で1つの表にまとまる。手動でスプレッドシートを作る工程が省ける。

次回計画をメモに追加し、ソース化する

工程5でNotebookLMが出力した次週の投稿計画を、ノートブックの「メモ」にコピーする。メモはそのままソースとして扱えるため、次回サイクルで「前回の計画と実績を比較して」と聞けば、計画と結果のギャップ分析ができる。

このステップが、PDCAサイクルを「1回きりの分析」から「継続的な改善サイクル」に変える接続点になる。

レポートを作成する

ソースの内容、AIチャットでの分析結果、次回計画までを含むレポートをStudioで生成できる。チャットで行った3段階のCheck、Actの改善方針、Planの投稿計画が、1つのドキュメントにまとまる。

一人で運用していても、クライアントやパートナーへの報告が必要な場面はある。チャットの会話履歴をコピペして整形する手間がなくなる。

スライドを作成する

生成したレポートをソースにして、スライド資料を作成できる。ソースとして投入した投稿画像もスライドに組み込まれるため、資料としての見栄えも確保できる。

注意:

- NotebookLMのスライド生成は日本語(特に漢字)が崩れることがある。社内資料やラフな共有資料としては十分だが、外部向けの正式な資料には手直しが要る

- きれいなパワーポイントが必要な場合は、レポートをClaudeに渡してスライドを作らせるほうが小回りが利く。Claudeならパワポファイルでダウンロードでき、各要素を個別に編集できる

ここまでやれば、分析→改善方針→次回計画→報告資料まで、1時間で完結する。

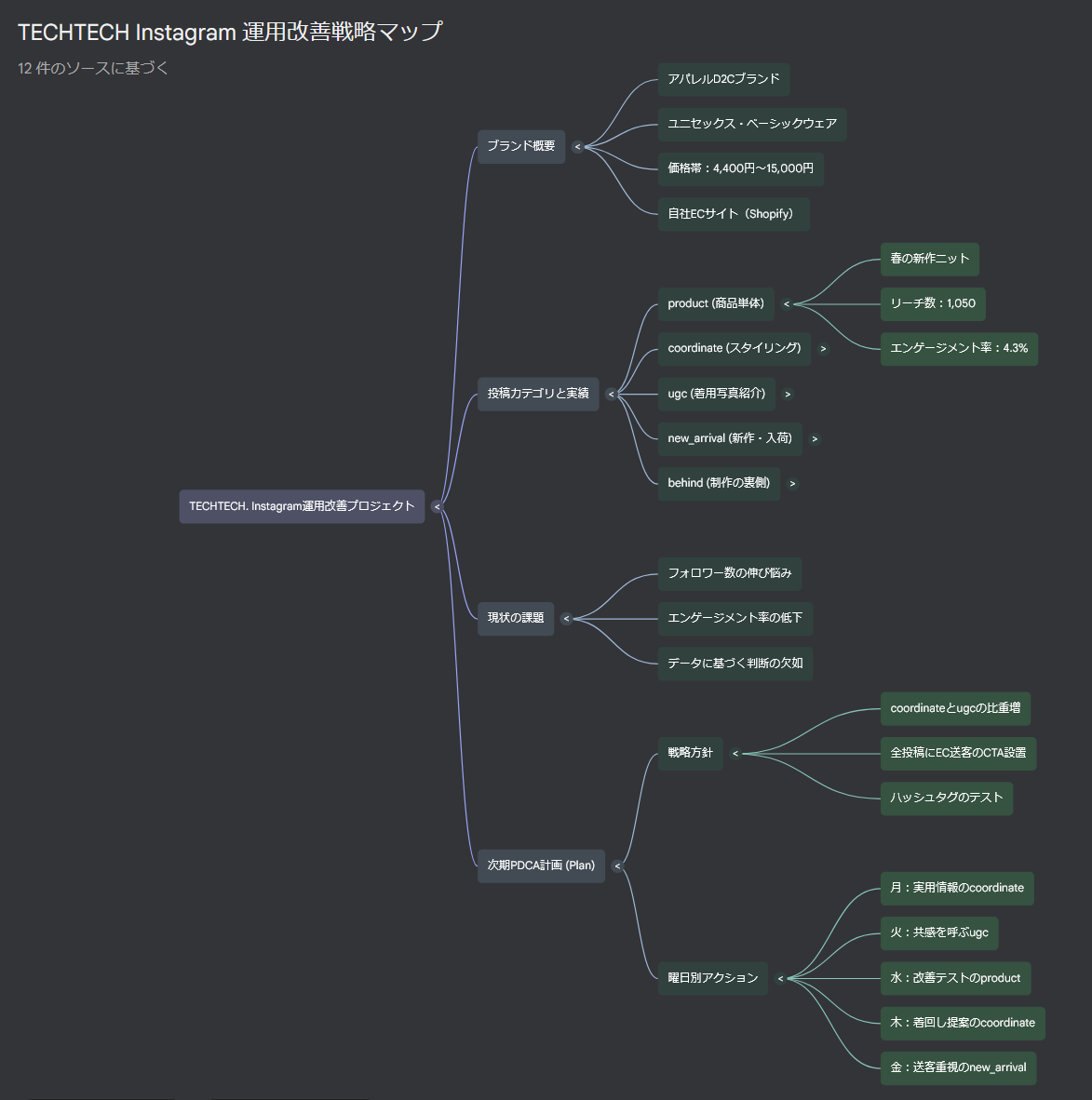

マインドマップ・インフォグラフィックで俯瞰する

NotebookLMのStudioにはマインドマップやインフォグラフィックの生成機能もある。プロジェクト全体の構造を視覚的に俯瞰したり、分析結果をビジュアルで共有したい場面で使える。

報告資料の本体はレポートとスライドで十分だが、プレゼンの補足資料やSNSでの共有素材として使い道がある。

【補足】Doフェーズについて

PDCAにおける最も重要なフェーズといってもいいのがDo。実際に動くことだ。今回のスコープ外。

NotebookLMは分析と思考の道具であり、コンテンツの制作はできない。

キャプションの執筆はChatGPTやClaude、画像の作成はGeminiやCanva——Doは別のツールの領域だ。次の1週間のDoが終わったら、新しい投稿データを同じ手順で追加し、工程3のCheckに戻る。それがPDCAサイクルとなる。

Doについては、以下の記事を参照にしてみてほしい。

評価

編集者あとがき

NotebookLMを触っていて、一番考えさせられたのは概要書の設計だった。

最初、評価指標の定義や分析の方向性をかなり詳細に書き込んだ。結果、NotebookLMの出力は毎回似たような構成になった。指示通りに動く優等生の回答。間違ってはいないが、発見がない。逆に概要書を薄くしすぎると、カテゴリの分類すら曖昧になり、分析の精度が落ちた。

結局、「目的と課題は明確に。分析の切り口は余白を残す」あたりに落ち着いた。ここに正解はない。自分のデータと目的に合わせて調整していくしかない。考えてみれば、それは人間のチームにブリーフィングするときと同じだ。指示が細かすぎれば作業者になるし、粗すぎれば方向を見失う。

もうひとつ。NotebookLMの出力にはソースの引用がつく。どのデータを根拠にしているかが見える。これに慣れてしまうと、引用のないAIの回答が急に心もとなくなる。「この分析、何を根拠に言っているのか」と問い返す癖がついた。ツールが変わったというより、自分の情報との向き合い方が少し変わった気がする。

この手法はSNS運用に限らない。営業データの振り返り、顧客フィードバックの整理、プロジェクトのKPI検証——「自分のデータだけで考えたい」場面なら、同じフレームワークが使える。次はクリエイティブのA/Bテスト結果を食わせてみたい。画像の中身まで読み取れるなら、ビジュアルの傾向分析もできるはずだ。

試してみて、合わなければ閉じればいい。無料だ。

こちらもおすすめ

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。