本を読まずに本を禁じるAI——あなたの組織にも同じ構造はないか

ZOO, inc. CEO / 毎日テクノロジーを追い、人間の可能性が拡張できるトピックスを探求している。

社内のコンプライアンスチェックをAIに任せたことがあるだろうか。判定理由は読まず、「問題なし」のラベルだけ確認して次へ進む。

いま米国の学校図書館で、この構造が蔵書に適用されている。AIが本をスキャンし、「不適切」と判定された作品が棚から消えていく。判定の根拠は、約300語の単語リスト。

この記事の要約

文脈を読まない判断は、誰の判断でもない

300語で「不適切」を定義するということ

BLOCKADEのソースコードはGitHubで公開されている。中を見ると、構造は単純だ。

約300の単語に重みづけスコアが振られている。AIはPDFやePUBファイルをスキャンし、これらの単語の出現頻度とスコアを集計して「リスクプロファイル」を生成する。出力はPDF形式のレポート。読んだ人間が判断を下す——という建前になっている。

注目すべきは、AIへの指示文に「追加のテキストや説明を含めないこと」と書かれていること。判定の理由をAIに返させない設計。

これは「判断」の外注ではない。「仕分け」の自動化にすぎない。

プロダクトの要件定義を書いてきた身からすると、この設計思想には見覚えがある。判断基準を明文化し、ルールに落とし込み、人間の裁量を減らす。工程管理としては正しい。ただ、それが「この本は子どもに読ませていいか」という問いに適用されたとき、何かが決定的にずれる。

「教育上不適切」の定義として設定されている文言がある。「保守的価値観に反するコンテンツ」。これが300語の単語リストと組み合わさったとき、フィルターは設計者の世界観を映す鏡になる。しかもその鏡は、自分が何を映しているかを説明しない。

『アラバマ物語』が引っかかる理由

テキサス州のニューブラウンフェルズ学区は、AI書籍審査ツール「BookmarkED」に約9,000ドル(約135万円)を支払い、蔵書のスクリーニングを導入した。結果、小学校から高校まで1,400冊以上の本が棚から消えた。新規の書籍購入も無期限で凍結されている。

ある小学校の司書が内部メールに書いた言葉が残っている。「BookmarkEDは、実行するたびに前より多くの本にフラグを立てているように感じる」「AIはコンテンツを全体として捉えるのではなく、フラグを立てているだけ」。

テキサス州リアンダー学区(Leander ISD)では、州法SB 12——学校でのDEI(多様性・公平性・包括性)コンテンツを制限する法律——に基づき、AIが授業教材を審査した。結果、ヴィクトル・ユゴーの『レ・ミゼラブル』、ハーパー・リーの『アラバマ物語』、サンドラ・シスネロスの『マンゴー通り、ときどきさよなら』が「要注意」として引っかかった。差別を描いた文学と、差別を推奨する文学。単語レベルのスキャンでは、その区別がつかない。

PEN America(米国ペンクラブ)の調査によれば、2024-25年度に全米で6,700件以上の禁書措置が記録されている。2021年以降の累計は約23,000件。これだけの数を人間が一冊ずつ読んで判断していたら、到底追いつかない。だからAIが導入された。効率化の動機には合理性がある。

この数をどう読むか。大量の蔵書を一冊ずつ人間が読んで判断するのは、現実的ではないだろう。何らかの効率化は避けられない。問題はAIを使うこと自体にあるのか、AIの出力をどう扱うかにあるのか。

BLOCKADEの設計に戻る。「説明を返すな」。BookmarkEDのフラグが撤去判断に直結する運用。共通しているのは、判断の間に「なぜ」を挟む余地がどこにもないこと。

この構造は書棚の外にもある

書籍検閲の話を、書籍検閲の話としてだけで閉じたくはない。

採用プロセスでAIが履歴書をスクリーニングし、フラグが立った候補者が面接に進めない。コンテンツモデレーションAIが文脈を読まずに投稿を削除する。コンプライアンスチェックAIが取引先のリスクを数値で返す。「人間が最終判断を下す」という建前の下で、AIのフラグが事実上の判定として機能している構造——これはBLOCKADEと同じものではないか。

ブレナンセンター(Brennan Center for Justice)の分析が、この構造を「説明責任の回避」と呼んでいる。AIが判定を下し、人間がそれを承認する。判断の責任を問われれば「AIが判定した」と言い、AIの設計責任を問われれば「ツールの使い方の問題」と返す。責任の所在が蒸発する。

何度も見てきた光景と重なる。会議で方針が決まる。だが「この判断を、私の責任で進める」と明言する人間がいない。なんとなく場の空気で合意が形成され、なんとなく承認が下り、実行に移される。誰が決めたかが曖昧なまま、意思決定だけが積み上がっていく。AIが加わると、「AIの出力に基づいています」の一言で、この曖昧さに正当性まで付与される。BLOCKADEの300語リストは、その構造が可視化された一例にすぎない。

ただ、AIのせいにしている人間は、この先立場を失うのではないか。AIは判定を返せる。責任は取れない。人間同士で成り立つ社会において、人間に対して「私がこの判断に責任を持つ」と言い切ること——結局、人間にしかできないのはそこだと思っている。自信を持って決める。明瞭に説明する。大胆に引き受ける。AI時代にこそ、価値が上がるマインドではないか。

日本の「包括指定」という鏡

日本にも、文脈を排除した自動判定の構造はすでにある。

46の都道府県が制定している青少年保護育成条例の「包括指定」制度。性的描写が全体の5分の1以上を占める、あるいは20ページ以上含まれる——といった数値基準を満たすと、個別の審議を経ずに自動的に「有害図書」に指定される仕組みになっている。

ページ数で判定する。単語数で判定する。構造は同じ。文脈を見ない。

この制度はAI以前から存在しており、BLOCKADEより歴史が長い。AIがこの構造に加わったとき何が変わるか。まず処理速度とスケール。一冊ずつ確認していた作業が、数千冊を一括で処理できるようになる。

ただ、ここは専門外の直感だが、本質的に変わるのは速度だけではないように思う。人間が一冊ずつ確認するとき——たとえ形式的な基準であっても——「これは本当にそうか」と立ち止まる瞬間がゼロではない。AIが一括処理したとき、その立ち止まりが消える。

判断とは、文脈の中で立ち止まることではないか。BLOCKADEは、立ち止まらない判断を大量生産する装置になっている。

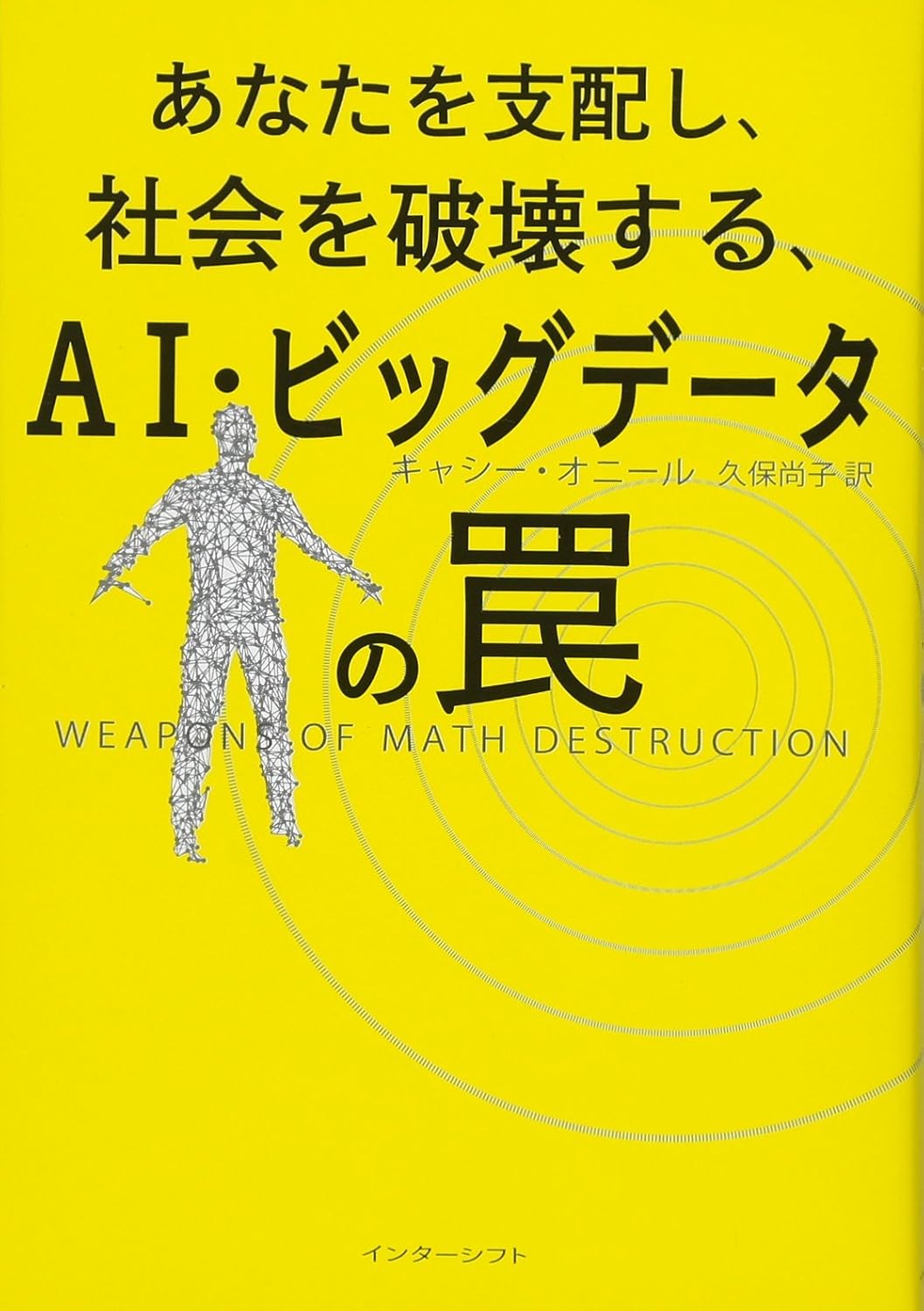

おすすめの映画・書籍

この記事の内容をより深く、よりリアルに追体験できるおすすめの映画・書籍をピックアップしました。

テクノロジーが社会やあなたに与える影響を深く考えるきっかけにしてください。

あなたを支配し、社会を破壊する、AI・ビッグデータの罠

報道記事・ソース

関連記事

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。