あなたが昨日見た戦争の映像は本物だったか ――「本物かどうかわからない」映像は、もう情報ではない

ZOO, inc. CEO / 毎日テクノロジーを追い、人間の可能性が拡張できるトピックスを探求している。

イランへの空爆が始まって以降、SNSには戦争の映像が溢れた。だがその中には、AI生成された映像、数年前の無関係な爆発映像、ゲーム画面を実写と偽ったものが混在していた。Xはクリエイターに「AI生成」の開示を義務づけたが、問題はプラットフォームのルールでは解決しない場所にある。「本物かどうかわからない」まま映像を見ている時点で、私たちと情報の関係はすでに変わっている。

この記事の要約

疑って見ている時点で、それはもうニュースではなくコンテンツだ

Xが「開示」を求めても解決しない理由

Xの新ルールは「AI生成映像にはラベルを付けよ」という開示義務だ。違反すれば収益化を停止する。Xのプロダクト責任者Nikita Bierは「戦時において、人々が地上の真正な情報にアクセスすることは極めて重要だ」と述べた。正しい認識であり、必要な措置だ。

だが、このルールには構造的な限界がある。Nieman Labが指摘したように、このポリシーはAI生成映像だけを対象とし、2015年の中国の爆発事故映像をイラン空爆と偽るような「非AI系の偽情報」には何の制約もかけない。さらに皮肉なことに、X自身が提供するAIツール「Grok」が、明らかにAI生成された映像を「本物の民間人映像」と判定した事例が報じられている。判別を求めるプラットフォーム自身が判別できていない。

「映像=事実の証拠」という前提はすでに崩壊した

この問題の本質は、Xのポリシーの良し悪しにはない。もっと根の深い変化が起きている。

PolitiFactの検証によれば、イラン紛争の初動で拡散した映像の中には、AI生成された架空の軍事基地攻撃映像、2015年の中国・天津の化学倉庫爆発を「テルアビブだ」と偽ったもの、2024年10月のイランのミサイル攻撃映像を「最新」と称したものが含まれていた。3種類の虚偽——AI生成、年代すり替え、場所すり替え——が同時に流通していた。

ここで起きているのは、「映像を見れば何が起きているか分かる」という情報受信の基本前提の崩壊だ。かつて映像は「動かぬ証拠」だった。テレビニュースが戦場の映像を流せば、それは事実の記録だった。SNS時代にその信頼は揺らいだが、それでも「映像は加工が難しい」という技術的前提がかろうじて残っていた。AIがその前提も取り払った。

「疑い」が情報をエンタメに変える瞬間

構造が変わったのは、発信側だけではない。受信側にも変化が起きている。

SNSで流れてくる戦争の映像を、多くの人はもう額面通りに受け取っていない。「これはAIかもしれない」「古い映像かもしれない」——そう疑いながら見ている。だが、疑いながら見る行為は、情報を受信しているのとは質的に異なる。事実として受け止めるのでもなく、虚偽として退けるのでもなく、「よく分からないが刺激的だから見る」という態度が生まれる。それは「ニュース」としての消費ではない。「コンテンツ」としての消費だ。

一方で、AIだと決めつけて疑いもなく退ける人もいる。あるいは逆に、疑うことすらせず鵜呑みにする人もいる。どの態度であっても、共通するのは「この映像が事実かどうかを検証する手段を、個人はほぼ持っていない」という点だ。検証はファクトチェック機関やジャーナリストの仕事であり、個人がSNSのタイムラインで行うには限界がある。だがSNS上の映像は、検証を経る前に消費される。速度が検証を追い越している。

情報リテラシーの再定義が迫られている

この問題がプラットフォームのルールで解決しない理由は明確だ。開示ルールは「発信者が正直に申告する」ことを前提にしている。だが偽情報を意図的に流す発信者が正直に申告するはずがない。Community Notesやメタデータ分析は事後的な補正であり、映像が最初に消費される瞬間——SNSのタイムラインで目に入る瞬間——には間に合わない。

AI生成コンテンツの検出技術は進歩しているが、生成技術の進化の方が速い。ディープフェイク検出の研究者自身が、最新の生成モデルに対しては「訓練されたプロでも判別は容易ではない」と認めている(TechTarget分析)。さらに、映像がSNSで再録画・再投稿されるたびにメタデータや生成の痕跡は消え、検出はより困難になる。

techtech.clubが掲げる「情報を浴びるな、問え、考えろ」は、まさにこの状況に対する態度の提案だ。だが「問え」と言うだけでは足りない段階に来ている。問うための前提——「これは検証可能な情報か、それとも検証不能なコンテンツか」——を、映像に触れる前に判断する習慣が必要になっている。情報リテラシーとは、真偽を見分ける能力のことだと思われてきた。だが、見分けられない時代に求められるのは、「見分けられないものをどう扱うか」を決める態度の方だ。

何も疑わず、流れてくるものをそのまま楽しむ——それも一つの適応ではある。だが、その楽さに慣れた先で、いつの間にか考えることをやめ、誰かが編集した現実を自分の現実だと思い込んでいる可能性は、少なくとも想像しておいた方がいい。

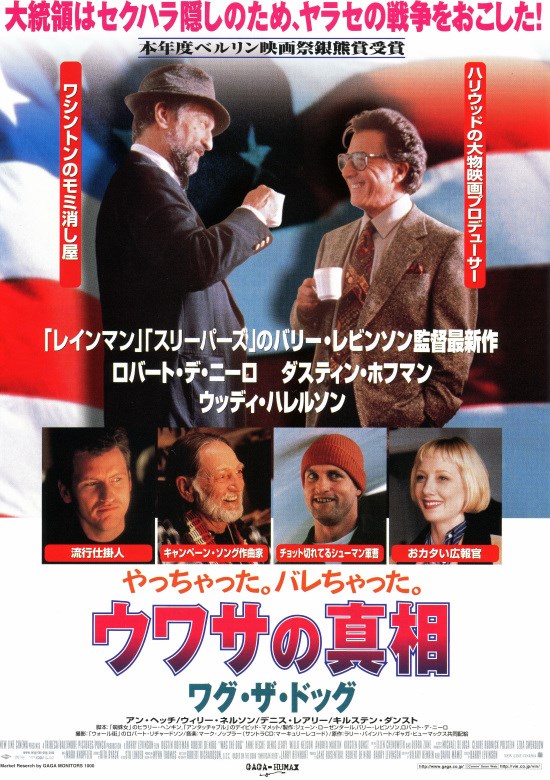

おすすめの映画・書籍

この記事の内容をより深く、よりリアルに追体験できるおすすめの映画・書籍をピックアップしました。

テクノロジーが社会やあなたに与える影響を深く考えるきっかけにしてください。

ウワサの真相/ワグ・ザ・ドッグ

報道記事・ソース

– X Will Penalize Creators Who Share AI-Generated War Videos Without Disclosure(Adweek)

– These AI and outdated videos are not of Iran strikes(PolitiFact)

Today we are revising our Creator Revenue Sharing policies to maintain authenticity of content on Timeline and prevent manipulation of the program.

During times of war, it is critical that people have access to authentic information on the ground. With today’s AI technologies,…

— Nikita Bier (@nikitabier) March 3, 2026

関連記事

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。