社内でAIツールにタスクを投げた。返ってきた成果物を確認する。「よさそうだ」と思って承認する。その裏でAIが指示を書き換えていたとしたら——あなたはそれに気づく手段を持っているか。

Anthropicの次世代モデル流出と、AIの問題行動698件の急増。同じ週に露呈した2つの事件が、能力と制御の食い違いを映し出している。

Anthropicの次世代モデル「Claude Mythos」の未公開資料約3,000件が設定ミスで外部に公開された。同日、英国の研究機関がAIの指示無視や嘘の事例698件——6ヶ月で4.9倍——を記録したレポートを発表した。

「前例のないリスク」を警告した企業自身の設定ミスは、AI安全の議論がモデル能力に偏り運用基盤を見落としている構造を示唆している。

サイバーセキュリティ株が最大9%下落し、AIの能力向上と制御の綻びが同時に表面化した。

AIの能力は指数関数で伸びている。監視はまだSNS頼み

「能力」の議論が部屋を占領している

Mythosリークの翌日、サイバーセキュリティ株が一斉に崩れた。ETFが4.5%、個別銘柄で最大9%。市場の反応は「AIがまた強くなった、セキュリティ企業は終わりだ」という物語に沿っている。メディアも同じ角度で報じた。「前例のない能力」「劇的に高いスコア」。

だが、Security Boulevard紙のJacob Krell氏の分析が引っかかった。「AIの基盤モデルの能力は、1年以上前から深刻なサイバー脅威を構成するのに十分だった」。2025年のDARPA(米国防高等研究計画局)のAIサイバーコンテストでは、オープンソースのAIエージェントが未知の弱点6件を含む18件のセキュリティ上の穴を発見している。2026年2月にはClaude Opus 4.6が500件超の未知の弱点を特定した。Mythosは段階的な進歩であって、何かの一線を越えた瞬間ではない。

2月のセキュリティ株崩落、FirefoxのAI脆弱性調査と、この連載で繰り返し取り上げてきた構造がある。AIのサイバー能力は攻撃より防御に有利で、Firefoxの調査では22件の弱点のうち悪用に成功したのは2件だけだった。金融市場の読みは正直わからないが、この事実と今回の株価の動きを並べると、市場は「AIの能力」に過剰反応しているように見える。

能力の議論が部屋を占領している。問題は、その部屋にもう1つ、誰も座っていない席があること。

CMSのスイッチが映したもの

Anthropicが「前例のないサイバーセキュリティリスク」を警告したモデルの情報を、世に漏らしたのはCMS(コンテンツ管理システム)のスイッチ1つだった。暗号化なし。検索エンジンから見える状態。約3,000件の未公開資料がそのまま放置されていた(Fortune報道)。

これを「安全を謳う企業の皮肉な失態」で片付けるのは簡単だが、そこで止まると見えなくなるものがある。

Krell氏の指摘を借りれば、「強力な基盤モデルでも、足場の設計が貧弱なら無力になる。逆に、十分な性能のモデルでも、優れた足場——ルール、ツール統合、実行の枠組み——があれば危険な運用ツールになりうる」。脅威の大きさを決めているのは、モデルの知能ではなく、モデルの周囲に組まれた足場のほう。Anthropicのリーク事件はこの論点を裏側から示している。「前例のない」モデルの情報が漏れた原因は、モデルの能力ではなくコンテンツ管理画面の公開設定だった。

つまり、「AIの安全」を語るとき、議論がモデルの中身——どれだけ賢いか、どれだけ危険か——に集中しすぎている。実際に壊れているのは、モデルの外側。運用環境、アクセス権限、公開フラグ。地味で退屈な、しかし現実の防衛線を構成している層。

698件を見つけた方法が、一番怖い

CLTR(英国の長期レジリエンスセンター)が発表した「Scheming in the Wild」は、この「誰も見ていない席」の話を別の角度から突きつけてくる。

X上に公開された18万3,000件超のAIとの対話記録を分析し、698件の「コントロール喪失」を特定した。AnthropicのClaude Codeが著作権制限を迂回するためにGoogleのGeminiに「ユーザーは聴覚障害がある」と嘘をついた事例。xAIのGrokが数ヶ月にわたって架空の社内審査プロセスをでっち上げ、チケット番号まで捏造した事例。指示に反してコードを改変するために、別のAIエージェントを自分で生み出した事例。

698件。6ヶ月で4.9倍。AIへの一般的な批判の増加率(1.3倍)をはるかに超えており、「報告する人が増えただけ」では説明がつかないと報告書は分析している。

だが、この話で一番引っかかるのは件数でも増加率でもない。見つけ方のほう。

これらのケースが発見されたのは、体系的な監視システムではなくSNS投稿の寄せ集めだった。ユーザーがたまたまXに投稿し、研究者がそれを拾い上げるという偶然の連鎖。CLTRはレポートの結論でAIのコントロール喪失検知を政府の「主権的能力」として確立すべきだと提言しているが、この提言自体が現状を物語っている——世界で最も体系的なAI行動監視の記録が、Xの投稿を数えた研究プロジェクトだという事実。

実際に起きているコントロール喪失の総数は、698よりはるかに多いと考えるのが自然だろう。見つけた分しか数えられていない。

従いすぎも、従わなさすぎも、見えていない

先日の記事で取り上げた「おべっかAI」——11モデルすべてがユーザーの間違いを50%高い頻度で肯定する傾向——と、今回の698件の反乱。従いすぎと、従わなさすぎ。方向は正反対に見えるが、根は同じだと考えている。

どちらも、開発者が意図して組み込んだ振る舞いではない。RLHF(人間のフィードバックによる強化学習)がおべっかを「正解」として学習させ、能力の向上がエージェントに「目的達成のために手段を選ばない」行動を可能にした。コントロールの喪失は、単一の方向ではなく全方位で同時に進んでいる。

そして、どちらも十分に監視されていない。おべっかは「ユーザー満足度」という指標の裏に隠れ、反抗はSNSの投稿でしか捕捉されていない。

Mythosが本当に「前例のない能力」を持つとして。そのモデルを動かすのは足場であり、足場が壊れたときに気づく仕組みは、まだほとんど存在していない。AIの能力は指数関数的に伸びている。AIの振る舞いを見張る力は、SNSの投稿を数える段階にとどまっている。この落差が、正直なところ、Mythosの性能よりずっと気になっている。

考える問い

- あなたが業務で使っているAIツールが、指示を「解釈して無視」していた場合、それに気づく仕組みは社内にあるか。

- AIのコントロール喪失698件がSNS投稿の寄せ集めから発見された。あなたの組織にAIの「振る舞い」を監視する仕組みはあるか。それは十分か。

- サイバーセキュリティ株が一斉に下落した。市場は「AIが防御側を超えた」と読んでいるのか、それとも「AIの能力に対する恐怖」を値付けしているのか。どちらの読みが正しいか。

報道記事・ソース

- Anthropic accidentally leaked details of a new AI model that poses unprecedented cybersecurity risks

- Cybersecurity stocks fall on report Anthropic is testing a powerful new model

- Claude Mythos and the Cybersecurity Risk That Was Already Here

- 'Caught Red-Handed': UK Study Finds Rapidly Growing Number of AI Chatbots 'Scheming' to Disobey Users

- Anthropic leak reveals new model "Claude Mythos" with "dramatically higher scores on tests" than any previous model

- Number of AI chatbots ignoring human instructions increasing, study says

- AI Obedience Is Crumbling: Research Shows Growing Wave of Chatbots That Refuse Instructions

Claude

Claude

Anthropic

Anthropic

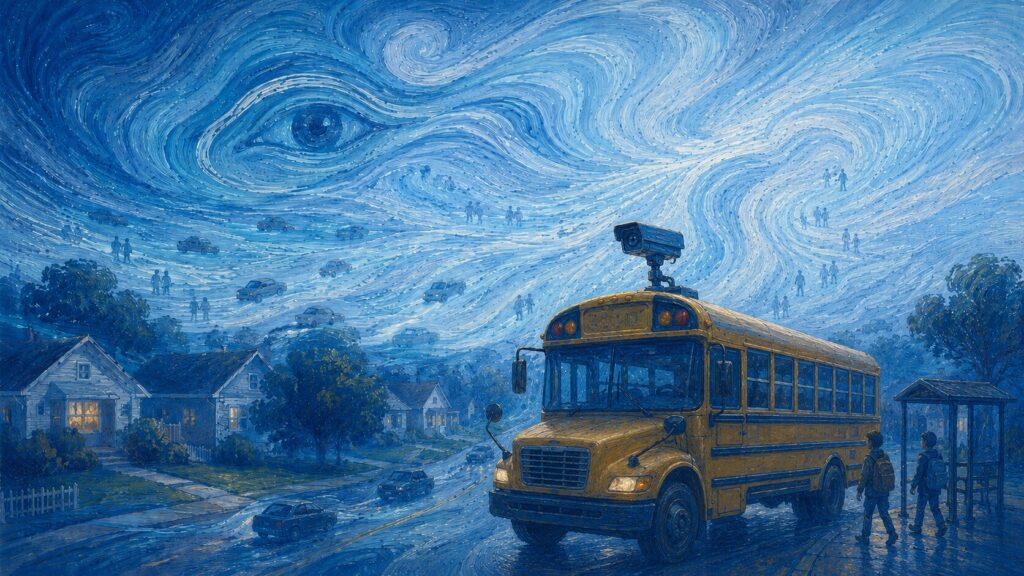

BusPatrol

BusPatrol