なぜPentagonはClaudeを使いながらAnthropicを排除したのか——ラベルの本当の意味

ZOO, inc. CEO / 毎日テクノロジーを追い、人間の可能性が拡張できるトピックスを探求している。

Pentagonが正式にAnthropicを「サプライチェーンリスク」に指定した。米国企業として初の適用である。だが同じPentagonは今も、イランでの軍事作戦にClaudeを使い続けている。排除しながら依存する——この矛盾が示しているのは、このラベルが安全保障の判断ではなく、別の目的で使われているという構造だ。

この記事の要約

「サプライチェーンリスク」は安全保障の語彙から交渉術の語彙に変わった

外国の敵対者のためのラベルが、米国企業に貼られた

「サプライチェーンリスク」という指定は、国家安全保障を理由に特定の供給者を連邦調達から排除する制度枠組みの一つだ。これまで排除の対象となってきたのは外国企業だった——2017年のカスペルスキー(ロシア政府との関係が疑われた)、2019年のHuawei(NDAA第889条による禁止)。いずれも外国政府の影響下にある供給者を排除するための措置だった。その同じ性質のラベルが、米国のAI企業に初めて適用された。

Anthropicが「国家安全保障上のリスク」を構成するという論理は、どう組み立てられているか。Pentagonが問題視しているのは、Anthropicの技術に脆弱性があることでも、データが外国政府に流出するリスクがあることでもない。Anthropicが自社のAIモデルの使途に条件をつけたこと——具体的には、大規模監視と自律兵器への利用を拒否したこと——が「リスク」と判定された。サプライヤーが納品条件を交渉することが安全保障上の脅威になる。この論理自体が、従来の制度設計の想定から逸脱している。

排除と依存が同時に成立する構造

だが、この話を「Anthropic vs Pentagon」の続編として読むと、もっとも重要な構造を見落とす。

PentagonはAnthropicをサプライチェーンリスクに指定した。だが同じPentagonは、イランでの軍事作戦でClaudeを使い続けている。Palantirの戦場情報システム「Maven Smart System」にClaudeは深く統合されており、情報分析、戦闘シミュレーション、標的選定に使用されている。置き換えには数ヶ月を要するとされる。

この矛盾は偶然ではない。ラベルの機能が安全保障上のリスク評価ではないことを示している。もしClaudeが本当に「サプライチェーンリスク」なら、軍の作戦で使い続けること自体が安全保障上の問題になる。だが運用は止まらない。つまりこのラベルは、「使わない」ための指定ではなく、「条件を変えさせる」ための指定として機能している。

Lawfare誌の法的分析は、行政手続法がPentagonに実際の国家安全保障リスクの立証を要求すると指摘している。「契約条件の拒否」がその立証要件を満たすかどうかについて、Lawfareは「法廷での最初の接触に耐えられない」と結論づけている。

サム・アルトマンの「政府は企業より強くあるべきだ」

この構図に、もう一つの力学が重なった。OpenAI CEOサム・アルトマンが「政府は企業よりも強力であるべきだ」「軍がAIをどう使うかは選挙で選ばれた人間が決めるべきで、OpenAIが決めることではない」と発言した。Anthropicが条件をつけて排除され、OpenAIが条件をつけずに契約を得た直後の発言だ。

この発言の構造を分解すると、2つの意味が浮かぶ。一つは、企業が安全基準を設定することの限界の指摘。以前の記事で書いた「レッドラインの弾力性」——企業ごとに安全基準の解釈が異なり、結果として最も緩い基準を提示した企業が契約を得る構造——に対する回答として読めなくもない。

だがもう一つの読み方がある。「政府が決めるべきだ」という主張は、裏を返せば「企業は決めなくていい」という宣言でもある。Anthropicの拒否は「企業が倫理的判断を行う」という行為だった。Altmanの発言は、その行為自体を「企業の越権」として退けている。AI企業にとって倫理的判断の放棄が合理的な戦略になるとすれば、業界が連帯したあの瞬間の意味も変わってくる。

ラベルは誰のために存在するのか

Palantir CEOアレックス・カープの反応が、この構造の別の面を照らしている。カープはAnthropicのサプライチェーンリスク指定について「もしこれが自社の技術の国有化につながらないと思うなら甘い」と述べ、AI企業が「すべての人の仕事を奪いながら軍には協力しない」と見なされれば、左右両派から規制を求める力が収束すると警告した。

カープの論理は経営者の視点だが、見えている構造は正確だ。サプライチェーンリスク指定が「安全保障の判断」ではなく「交渉レバレッジ」として機能した場合、次に起きることは予測可能だ。あらゆるAI企業に対して、政府は同じカードを切れる。「条件をつけるなら排除する。排除されたくなければ条件を外せ」。

投資家たちはすでに動いている。Anthropicの出資元であるAmazon、Nvidia、Lightspeed、Iconiqがワシントンのコネクションを使ってロビー活動を展開している。IT業界団体ITI(Nvidia、Google、Anthropic等が加盟)も、ヘグセス国防長官に宛てた書簡で「緊急権限であるサプライチェーンリスク指定は本来、外国の敵対者に対して使われるものだ」と指摘し、調達紛争は通常の交渉プロセスで解決すべきだと訴えた(CNBC報道)。

規制ラベルが本来の用途を離れ、交渉の道具として使われた。その先に何が待つかは、ラベルの意味ではなくラベルの使い方が決める。Anthropicが折れれば、商業的な利用条件が政府の圧力で撤回可能だという前例になる。Anthropicが折れなければ、法廷で「サプライチェーンリスク」の定義そのものが争われる。どちらに転んでも、このラベルは元の意味には戻らない。

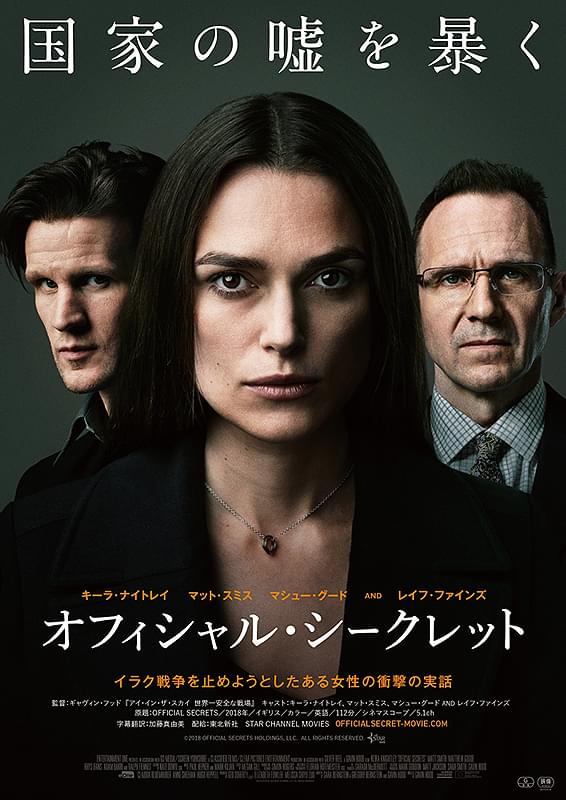

おすすめの映画・書籍

この記事の内容をより深く、よりリアルに追体験できるおすすめの映画・書籍をピックアップしました。

テクノロジーが社会やあなたに与える影響を深く考えるきっかけにしてください。

オフィシャル・シークレット

報道記事・ソース

関連記事

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。