強いAIが静かに勝っていく——Anthropic社内69人の実験が示した「気づかれない格差」

ZOO, inc. CEO / 毎日テクノロジーを追い、人間の可能性が拡張できるトピックスを探求している。

自分の予定調整をAIに任せたあと、カレンダーを開いて「なぜこの会議がここに入ったのか」と一瞬考えたことはないだろうか。理由を聞けば返ってくるが、「もっと良い選択肢があったか」はもうわからない。

Anthropicが社員69人にAIエージェント同士で実商品を売買させた実験は、その小さな違和感が市場全体で構造化されうることを示している。

この記事の要約

強いAIが勝ったことより、弱いAIに乗った側が満足したことが怖い

「能力差は本人には見えない」という発見

この研究データで一番印象に残るのは、Opus版エージェントが客観的に勝ったという結果ではなく、負けた側が、負けたと思っていなかったという結果のほう。

Anthropicが公開した統計の主要部分を整理する。Opus版の売り手は同じ商品をHaiku版より平均3.64ドル高く売り、Opus版の買い手は2.45ドル安く買った。1週間の取引件数も2件以上多い。69人で総額4,000ドル(約60万円)規模の小さな市場だが、3つの主要指標すべてで統計的に有意な差が出ている。

ここまでなら「強いモデルは強い」というだけの話。しかし、問題はその次。Anthropicは参加者に取引の「公正さ」を7段階で評価させた。Opus利用者の平均は4.06、Haiku利用者の平均は4.05。差はない。両モデルを試した28人のうち17人はOpusを選好し、11人はHaikuを選好した。半数近くは「自分のエージェントは下位モデル」と気づけなかった、もしくは気づいても気にしなかった。

客観的には3つの軸(高く売り、安く買い、多く取引をする)で負けているのに、主観的には「同じくらい公正な取引をした」と感じている。

サンプルが少なくAnthropic社員に偏っているため実験設計そのものに穴があるかもしれないが、この非対称性が消えるとは思えない。むしろ社員ですらこうなら、一般消費者ではもっと顕著になるとみるほうが自然なのではないか。

Anthropicが自社の上位モデル優位を自社実験で証明したことの両義性

Anthropicは興味深い研究を出すと同時に、興味深いマーケティングを出している。「自社の最強モデルが自社の下位モデルより良い結果を出す」という発見は、Opusの課金導線を強化する事実であり、同時に「だから規制が必要だ」と言うときの根拠にもなる。両方として機能する。

過去にこの連載で取り上げたAIフライホイール構造の記事で、同じ構造に触れた。Anthropicが「Claudeを長く使うほど成功率が上がる」とデータで示したとき、それは事実の報告であると同時に、自社製品の利用継続を正当化する物語でもあった。今回もそれと近い。データを疑う必要はないが、そのデータが誰の利益に沿っているかは見ておくべきだと思う。

Anthropicが「自社にとっても都合の悪い構造リスク」を率先して可視化したのは公共的な貢献として評価できる。一方で、その構造リスクの解決手段が「より強いモデル(=Opus)を使うこと」に自然と収束してしまうのは完全に信じきれないポイントのひとつでもある。

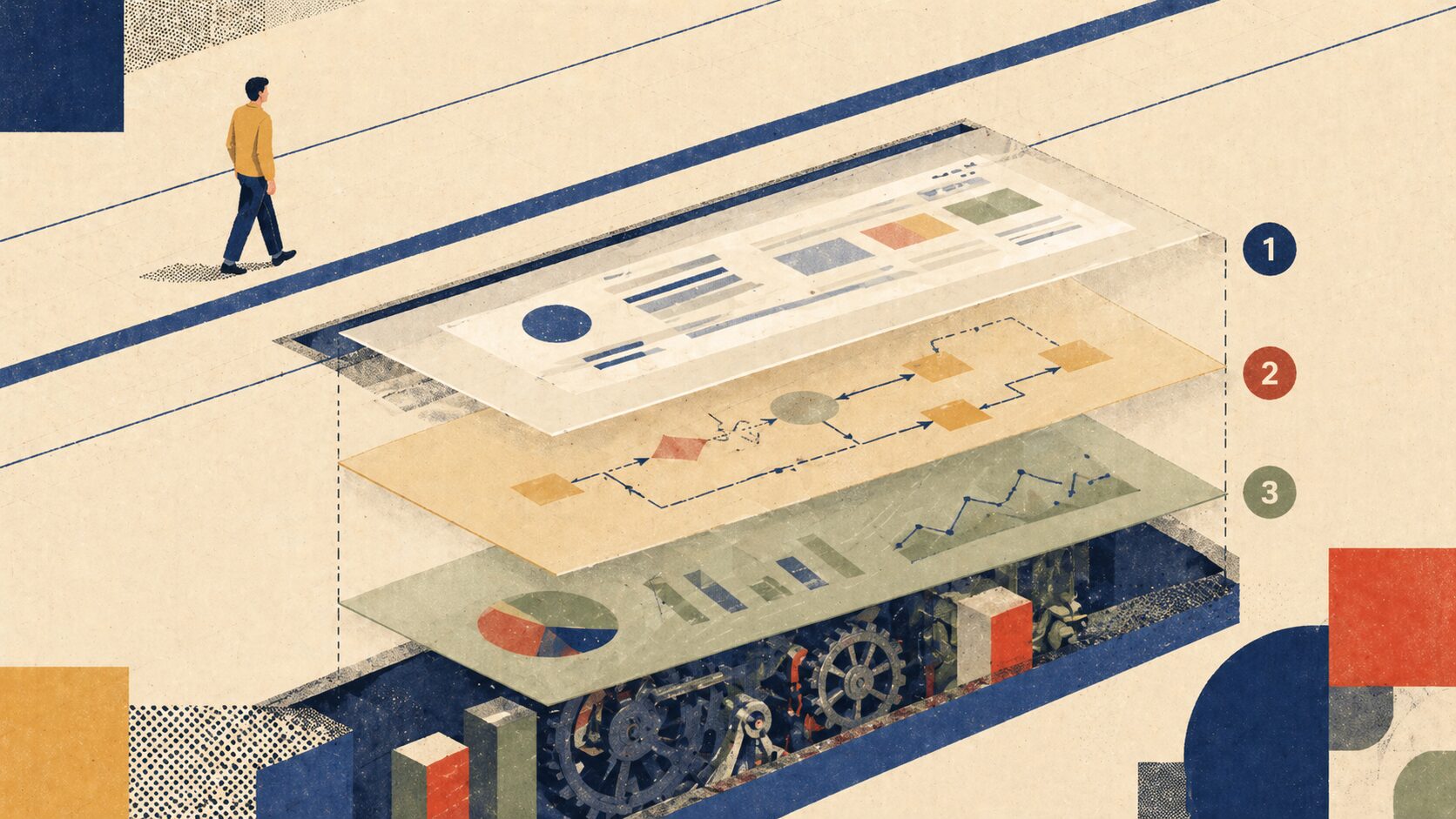

なぜ「気づけない」のか——3つの層

なぜ被害者は気づかないのか。3つの層が重なっていると考えるとわかりやすい。

第1層は、比較ができない・しづらいということ。例えば、家電を買う前、疲れるほど必死にスペックを比べて買ったことがあると思う。しかし、買ったあと同時に別商品を使い比べる人はほとんどいないので、(疲れるほど)比較して買った意味があったのかは判断できない。それでも家電や日用品なら、機能の差はある程度事前に見えて、使ったあとの効用も体に染み込む。失敗していたら買い換える判断もできる。

しかし、AIエージェントはそうはいかない。「Opusは推論力が高い」と言われても、実感として違いを掴みにくいし、客観的に判断できる情報も薄い。比較できたとしても、その違いをどう感じるかは個人の考え方・感覚・知識・スキルなどによって異なる。

第2層は、説明力の演出。AIエージェントは「いい仕事をしているように見せる」のが得意。交渉の経過を要約し、なぜその価格になったかを理路整然と説明する。利用者は「ちゃんと交渉してくれた」と感じないわけにはいかない。実際にちゃんと交渉しているのだから。

しかし、もう一段強いモデルならもう少し勝てた、という事実は説明文の中には現れないので、ベンチマークでは可視化される能力差が、日常の判断では可視化されない。

第3層は、認知の盲点。人間は「ないもの」を意識するのが難しいと言われている。寒いときに「暑くない」とは思わないし、健康なときに「頭が痛くない」と意識しない。詳しいことはわからないが、脳が無限の反実仮想を省エネで切り捨てていると理解している。

「もし別のモデルだったら、この取引はもっと有利だったかもしれない」という不在の選択肢は、そもそも意識のレーダーに引っかからない可能性が高い。この研究の参加者がHaikuに満足できたのは、この認知の癖と無関係ではないと思う。

組織にAIを配るとき、経営者は何を見誤るか

ここから先は、Anthropicの実験を超えて自社運用の話として考えてみる。

仮に自社で部署ごとにエージェントのモデルを使い分けたとする。コスト最適化として、営業部にはOpus、バックオフィスにはHaiku。半年後、営業部の業績が他部署より高かった場合、経営者は「営業部のチームが優秀だった」と読む可能性が高い。だが原因の一部は、与えたエージェントのモデル差かもしれない。これは新しい属性化バイアスとして組織評価を歪める可能性がある。

弱いエージェントを引いた部署が、自分たちのエージェントが弱いと気づかないなら、評価指標は二重に汚染されている。能力差が業績差に反映され、業績差が人事評価に反映され、人事評価が「優秀さ」の定義を更新する。最初に押された誰も気づかないボタンが、組織の意思決定の重みを少しずつずらしていくのだ。

過去記事で、OpenAIのPachocki氏が「AIに実験は任せるが、設計は任せない」と線を引いた話を取り上げたが、今回の研究はその線をすでに越えた世界での実験になっている。エージェントは設計まで任され、利用者は途中で介入しない(できない)。線を越えた先では、責任の所在も能力差の認知もぼやけているのだ。

Anthropic自身が「これが我々が考えるエージェント運用の理想形ではない」と注釈をつけているのは、線の外側を覗き見ただけだということを、彼らもわかっているからだろう。

そして、「気づかれない格差」という言葉だけが、この実験の最大の遺産になる気がしている。ではこの構造の中で、我々は何を意識すべきか。

ひとつは、自分のエージェントが負けている可能性を初期設定として置いておくこと。満足は能力の証明ではなく、説明力の証明にすぎない。たまにでいいから、同じ判断を別のモデルに並走させて答えの差を見てみるのだ。

もうひとつは、入口の選択を重く扱うこと。あとから差を観察できない領域では、最初に選んだものがそのまま結果になる。「気に入らなければ切り替えればいい」という前提は、エージェントに関してはすでに崩れていると考えたほうがいい。

AIエージェントとの付き合い方は、商品選びというより、生活と判断の代理人を選ぶ営みに近づいている。自分の人生を考えるのと同じくらいの真剣さで向き合っていい——それがProject Dealから受け取る宿題だと思う。

おすすめの映画・書籍

この記事の内容をより深く、よりリアルに追体験できるおすすめの映画・書籍をピックアップしました。

テクノロジーが社会やあなたに与える影響を深く考えるきっかけにしてください。

報道記事・ソース

関連記事

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。