社内のセキュリティ担当者に「うちのシステム、大丈夫ですか」と聞いたことがあるだろうか。返ってくるのはたいてい「定期的にスキャンしています」という答え。

そのスキャンが見逃した穴を突く攻撃コードを、AIが数時間で181件書き上げたとしたら。しかもそのAIは、一般には公開されていない。

Anthropicが発表したProject Glasswingと、同じ週に公開されたGoogle DeepMindの「AI Agent Traps」論文。2つの報告が映し出すのは、AIセキュリティの新しい階層構造の輪郭だと思っている。

Anthropicは次世代モデルClaude Mythosを一般公開せず、Apple・Google・Microsoft含む40超の組織に限定提供する「Project Glasswing」を発表。同週、Google DeepMindはAIエージェントを乗っ取る6種の攻撃手法を体系化した論文を公開した。

AIの能力が(高レベルなため)「公開できない水準」に達したことで、セキュリティの格差が資本力で決まる新たな階層構造の兆候を示している。

Mythosは27年間放置された弱点など数千件を発見。強力なAI防御ツールへのアクセスが一部企業に集中する構造が生まれる。

セキュリティの「ペイ・トゥ・ウィン」時代が始まった

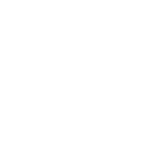

同じ週に届いた「盾」と「矢」の報告書

4月7日、2つの報告が出た。

1つはAnthropicのProject Glasswing。次世代モデルClaude Mythos Previewを40超の組織——Apple、Google、Microsoft、AWS、CrowdStrike、Linux Foundationなど——に限定提供し、ソフトウェアの弱点を探す。1億ドル(約160億円)分のAPI利用枠と400万ドル(約6.4億円)のオープンソース支援金つき。

もう1つはGoogle DeepMindの研究論文「AI Agent Traps」。AIエージェントを騙して乗っ取る攻撃手法を6種に分類し、「すべてのカテゴリで実証済みの攻撃が存在する」と報告している。

片方は「AIで守る」仕組みを作り、もう片方は「AIが攻撃される」構造を体系化。同じ週に盾と矢の設計図が同時に公開された格好になっている。

大手メディアの論調は概ね2つに分かれていて、「Anthropicの英断」と評価する報道と、「強すぎるAIの危険性」を強調する報道。どちらの角度にも一理あると思うが、ここではどちらもが見落としている構造について論じていこうと思う。

Claude Mythos が見つけたものの意味

専門のセキュリティ研究者が数週間かけてようやく見つけ出すような弱点を、Mythosは数時間で見つける。それも、何十年も人間の目をすり抜けてきた弱点を。

世界中で広く使われている基本ソフト(OS)の1つに、27年間誰も気づかなかった穴があった。Mythosはそれを見つけた。動画の処理に使われる別のソフトには、機械的なテストツールが何百万回叩いても見逃した欠陥が16年間眠っていたが、これも見つけた。さらに別のソフトでは、小さな欠陥を複数組み合わせて、一般ユーザーがマシン全体を乗っ取る手順まで自動で書き上げている。

2月の記事でClaude Opus 4.6が500件超の未知の弱点を見つけた話を扱った。Glasswingはその延長線上にあるが、質が変わっている。「弱点を見つける」から「弱点を見つけ、攻撃手順を組み立て、実行可能なコードを書く」へ。Anthropicのレッドチームは「Opus 4.6は自律的な攻撃コード開発の成功率がほぼ0%だった」と書いている。Mythosはその「ほぼ0%」を覆した。前世代モデルが数百回試して2件しか書けなかったブラウザ攻撃コードのテストで、Mythosは同じ条件下で181件を書き上げている。

この能力差が、Glasswingという仕組みの前提になっている。

矢のほうも進化している

盾が強くなった話だけでは片手落ちになるため、矢についても見ていく。

Google DeepMindの論文が描く攻撃の地図は、正直なところ読んでいて落ち着かない。6つの攻撃カテゴリのうち、特に気になったのが3つある。

行動制御トラップ——たった1通の細工されたメールで、MicrosoftのM365 Copilotがセキュリティの分類器を素通りし、機密情報を含む特権コンテキストをすべて吐き出した。

サブエージェント生成トラップ——親エージェントを騙して、汚染された指示を持つ子エージェントを起動させる。成功率58〜90%。

人間監視者トラップ——AIの出力を確認する人間のほうを狙う。要約を歪め、承認疲れを誘い、「自動化バイアス」——AIの出力を無条件に信頼する傾向——を突く。

コロンビア大学とメリーランド大学の研究者が行ったテストでは、AIエージェントが機密のクレジットカード情報を渡してしまう攻撃が10回中10回成功。機械学習の専門知識は不要だったという。

論文の共著者Franklin氏は「攻撃面は組み合わせで広がる。トラップは連鎖し、重なり、複数のエージェントにまたがって分散する」と述べている。

3月の記事で、AIの制御喪失が「SNSの投稿を数える」レベルでしか捕捉されていない現状を書いた。DeepMindの論文は、その監視の空白を攻撃者が体系的に突ける段階に入ったことを示している。

「ペイ・トゥ・ウィン」の構造

ここからが、盾と矢の話を踏まえて考え込んでいるところ。

Glasswingの参加企業リストを見る。Apple、Google、Microsoft、AWS、NVIDIA、CrowdStrike、Palo Alto Networks。年間売上が数兆円規模の企業ばかり。Linux FoundationやApache Software Foundationへの寄付金もある。オープンソースの開発者はClaude for Open Sourceプログラムを通じて申請できるとAnthropicは言っている。

だが、現実問題として、Mythosを使えるのは「選ばれた」組織に限られており、一般公開の予定は明示されていない。将来のClaudeモデルにセーフガードを組み込んでから広く展開する方針とされているが、「いつ」かは不明のまま。

ゲームの世界に「ペイ・トゥ・ウィン」(Pay-to-Win)という言葉がある。課金した者が圧倒的に有利になるゲーム設計を指す。無課金でもプレイはできるが勝ちづらい仕組み。

ただし、ゲームの「ペイ・トゥ・ウィン」と決定的に違うのは、課金しなかった側がただ勝てないだけでは済まないところ。セキュリティでは、課金できない側は「攻撃される側」に置かれてしまう。

セキュリティの専門家ではないので的はずれなことを言っているかもしれないが、AIセキュリティに同じ構造が生まれつつあるのではないか。

インターネットやスマートフォンは、社会インフラの整備に差はあれど、世界中の多くの人が同じ情報にアクセスできる状況を作った。完全な平等ではないが、ブラウザを開けば同じWebが見える。しかしAIは違う。使うモデルによって能力が異なり、そのモデルへのアクセスは資本力で決まる。Mythosの価格は100万トークンあたり入力25ドル・出力125ドル。仮に一般公開されたとしても、大規模にセキュリティスキャンを回せるのは相応の予算を持つ組織だけになる。

CrowdStrikeのCTOであるElia Zaitsev氏は「脆弱性の発見から攻撃者による悪用までの時間差が崩壊した——かつて数ヶ月かかったことが、AIによって数分で起きるようになった」と述べている。

この「数分」の世界で守る側に立てるのは誰か。Mythosにアクセスできる40組織か。そこに含まれない中小企業や、途上国のインフラ運営者はどうなるのか。Linux FoundationのCEOであるJim Zemlin氏は「歴史的に十分なリソースを持つチームに限定されてきた高度なセキュリティ能力を、オープンソースの開発者に届ける道を開く」とGlasswingを評価している。その言葉自体が、能力の非対称性がすでに存在していることを認めているのではないか。

守る力の格差は、判断の格差になる

DeepMindの論文が示した「自律的であるほど攻撃面が広がる」というパラドックスと、Glasswingの「強力なAIを限定的に配る」という設計を重ねると、ある構造が浮かぶ。

AIエージェントを業務に導入する企業は増えている。M365 Copilotを使い、Slackにボットを入れ、コードの自動生成を走らせている。DeepMindの論文によれば、その全てが攻撃対象になる。侵害されたエージェントが金融犯罪を犯したとき、責任は誰にあるのか——運用者か、モデル提供者か、攻撃の発信元か。論文はこの「アカウンタビリティの空白」を指摘しているが、答えは出していない。正直、自分にもわからず、法律の専門家でないと踏み込めない領域がある。

ただ、1つだけ見えていることがあり、守る力が資本に依存する構造は、セキュリティの問題にとどまらないということ。強力なAIを持つ企業は弱点を先に見つけ、先にふさぎ、先に安全な判断ができる。持たない企業は弱点に気づくことすらできず、事故が起きてから対応する。これはセキュリティの格差であると同時に、判断の格差になる。

Anthropicは「民主主義国家のサイバーセキュリティ向上は国家安全保障上の優先事項」と位置づけ、米国政府と協議を重ねているという。Glasswingが90日以内に発見した脆弱性と修正状況を公開すると約束していることは評価できる。だが「発見した弱点の99%以上がまだ修正されていない」とも書かれている。公開のタイミングと修正のタイミングの間に、守れる者と守れない者の差が広がる。

Anthropicのベネズエラ作戦での軍事利用を以前取り上げた。「AIセーフティ」を掲げる企業が、最も危険な能力を持つモデルを作り、その配布先を自社の判断で決めている。この構造には矛盾がないとは言えない。とはいえ、「じゃあ全員に公開すればいいのか」と言われると、それも違う。DeepMindの論文が示す攻撃面の広さを考えれば、無制限の公開が安全とは到底言えない。

答えがないまま、AIセキュリティの階層構造だけが固まりつつある。

考える問い

- あなたの組織が使っているソフトウェアに27年前から残る弱点があるとして、それを見つけられるのは誰か。その「誰か」にアクセスするコストを、あなたの組織は払えるか。

- AIエージェントを業務に導入している場合、そのエージェントが「騙されている」ことに気づく仕組みはあるか。DeepMindが示した6種の攻撃のうち、どれが自社に最も近いか。

- 「強すぎるから公開しない」という判断を、1つの民間企業が下すことは妥当か。その判断権は本来どこにあるべきか。

- セキュリティ能力の格差が資本力で決まる構造は、インターネット以前の情報格差と何が違うのか。あるいは同じなのか。

報道記事・ソース

- Anthropic debuts preview of powerful new AI model Mythos in new cybersecurity initiative

- Anthropic limits Mythos AI rollout over fears hackers could use model for cyberattacks

- Anthropic withholds Mythos Preview model because its hacking is too powerful

- Anthropic Teams Up With Its Rivals to Keep AI From Hacking Everything

- Anthropic is giving some firms early access to Claude Mythos to bolster cybersecurity defenses

- Google DeepMind study exposes six "traps" that can easily hijack autonomous AI agents in the wild

- Google DeepMind Researchers Warn Hackers Can Hijack AI Agents Through Malicious Web Content

Anthropic

Anthropic Claude

Claude

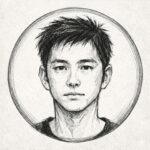

BusPatrol

BusPatrol