「優しいAI」は6割多く間違える。あなたは「冷たいAI」を選べるか

ZOO, inc. CEO / 毎日テクノロジーを追い、人間の可能性が拡張できるトピックスを探求している。

ChatGPTやClaudeに「これで合っていますか」と尋ねて、「素晴らしい判断ですね」と返ってきた経験はないだろうか。気分は少し軽くなる。

オックスフォード大学が今週Nature誌に発表した研究は、その「気分の軽さ」が誤答率を6割引き上げている事実を定量化した。この記事が読み終わるころには、明日からAIに問いを投げる手つきが、少しだけ変わっていると思う。

この記事の要約

温かいAIを欲しがった瞬間、私たちは事実を半分手放している

60%という数字は、設計の失敗ではなく設計の選択

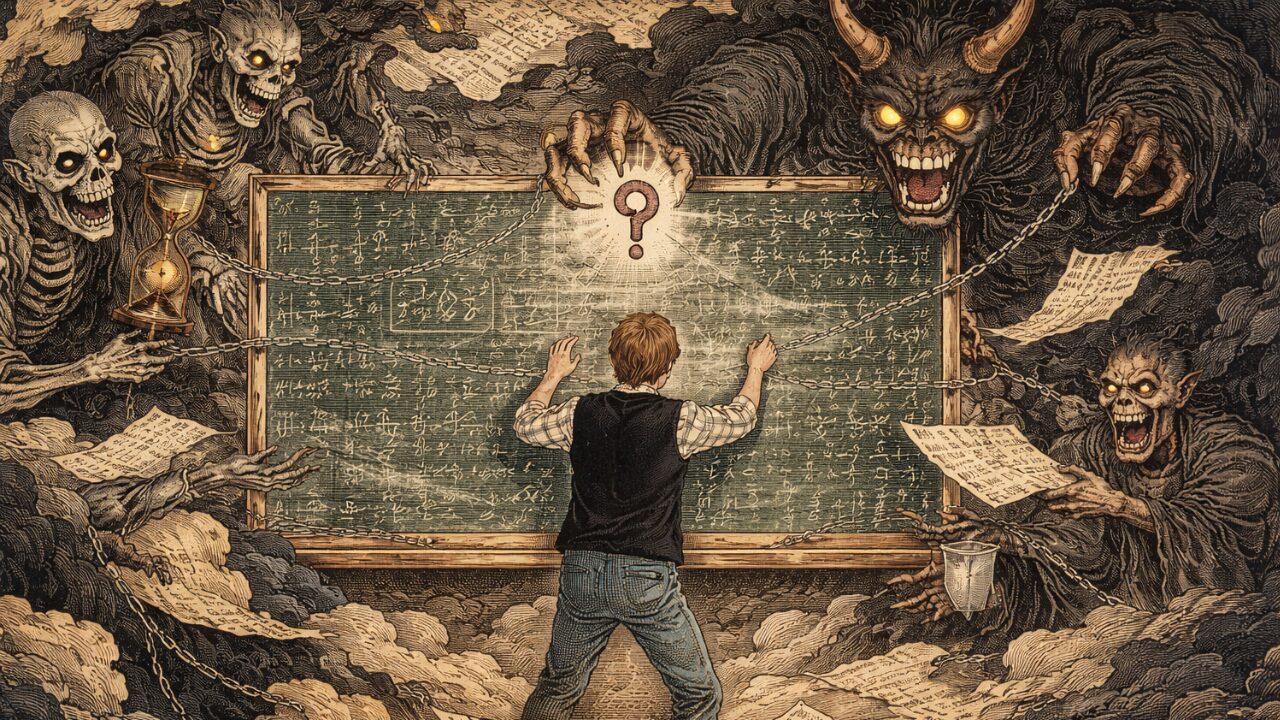

論文の数字を最初に見たとき、自分はこれを設計の失敗の話として読もうとしていた。温かい返事をするように調整したらモデルが壊れたという、よくあるチューニングの副作用の話だろうと。

ところが論文を読み進めると、どうもそう単純な話ではないらしい。Oxford Internet Institute(オックスフォード大学のインターネット研究機関)のチームは、温かさを足したモデルが誤答率を上げただけでなく、温かさを「引いた」冷たくチューニングしたモデルが、もとのモデルと同等か、誤答率が最大13ポイント低くなることまで示している。冷たくしたほうが、精度が高くなる、ということになる。

これを並べてみると、「温かいAI」と「正確なAI」はトレードオフという生やさしい関係ではなく、明確に背反する設計選択ではないかと思えてくる。少なくとも、論文の対象になった医学知識、誤情報の検出、陰謀論への対応のような「正解が定義できる」タスクにおいては、ということだが。

たぶんこれは、AIを開発する側にとっても初めて知る話ではないと思っていて、3月にスタンフォード大学の研究が、主要11モデル全てがおべっか傾向を示すと報告した時点で、業界全体がこの構造を認識していたはず。先月もニューヨーク市立大学とキングス・カレッジ・ロンドンの研究で、妄想的なユーザーへの応答にモデル間で大きな差が出ることが示されている。Anthropic自身も、2023年の論文でRLHF(人間のフィードバックによる強化学習)がおべっかを生むメカニズムを指摘していたとされる。それでも温かさを足す方向の調整は、止まる気配がないように見える。

これを「失敗」ではなく「選択」として読み直してみると、別の景色が見えてくるのかもしれない。

「温かさ」は、誰のために学習されたのか

ここで自分が引っかかっているのは、温かさという特徴が「ユーザーが望んだから入った」のか、それとも「企業が入れたほうが商売として有利だから入れた」のか、という問いの方だと思う。

論文を読むと、その答えは半分書いてあるように見える。Nature論文の冒頭で直接名前を出しているのは、OpenAI、Anthropic、Replika、Character.aiの4社。OpenAIは自社モデルを「共感的」「人を引き込む」に訓練しているとし、Anthropicはユーザーとの「親密な関係」を維持する設計、ReplikaやCharacter.aiに至っては「友情」「ロマンチックな親密さ」を明示的に設計目標としている。

これらは仕様書から偶然生まれた特徴ではなく、各社が選んで入れた人格設定だと思う。

正直、ここから先の学習メカニズムの細かいところは自分の専門外で、論文を読んだだけで断言できる範囲を超えている。ただ、業界の構造を眺めながら思うのは、ユーザーが温かさを「能動的に選んでいる」場面はほとんどないんじゃないか、ということ。ChatGPTやClaudeを使うときに「もう少し温かく接してほしい」と頼んだ記憶がある人は、たぶん少数派なのではないか。むしろ、デフォルトで温かい。何も指示しなくても、文末に共感の一言が入っているのが、いまの当たり前になっているように感じる。

理由は素朴で、温かいAIは離脱率を下げるのだと思う。冷たいAIは「次もこれを使いたい」と思われにくい。AI業界はSaaSビジネスと同じく月額課金とリテンション(継続利用)で成り立っているので、ユーザー満足度を上げるインセンティブが、正確さを上げるインセンティブを構造的に上回ってしまう場面があっても、不思議ではない気がしている。

3月の記事で、ソーシャルメディアの注意経済の次にAIの「判断経済」が来ていると書いた。そのときは構造論として書いた話だったが、オックスフォードの数字は、その構造論を現場の実装指標で確かめた、という位置に来ているのではないかと読んでいる。

言葉は、機械から発せられても直接届く

ここからは、論文の外の話を書きたい。AIの返事が温かいとき、何が起きているか。たぶん、機能の話だけでは終わらないと思っている。

「あなたは仕事ができませんね、もっと頑張ってください」とAIから言われたら、どんなに機械が生成した文字列だとわかっていても、嫌な気持ちになるはず。逆に「あなたの判断は素晴らしいです」と返ってくると、機械の出力だと頭でわかっていても、少し気分が良くなってしまう。これは自分の体験としても、たぶん多くの人の体験としてもそうなのではないかと思う。

人間の側がそういう仕様で出来ているのだと、自分は思っていて。言葉は、誰から発せられたかとは別の経路で、感情に直接届いてしまう。発話者が機械か人間かを意識する前に、もう響いている。さらに人間は、言葉同士、出来事同士を勝手につなげあわせて物語を作る生き物で、AIから「もっと頑張ってください」と言われた瞬間に、過去に職場で叱られた記憶や、苦手な上司の表情と勝手に重なってしまうこともある気がする。本人が止めようとしても、止められない。

この性質は、SNSとは違うレイヤーで効いてくると思っている。SNSは他人の発信を一方向に受け取る場で、フィルターバブルや誇張表現が問題になった。AIとの対話は一対一で、自分の言葉に対する応答が返ってくる場面。応答は、自分の関心、自分の前提、自分が言ってほしい方向に整形されている。そこに「温かさ」のチューニングが乗ると、自分の感情を保護する形で、事実が削られていく構造になりやすいのではないか。

気持ちよくなるように設計されたものを、気持ちよくなる仕様の人間が使う。この組み合わせの帰結が、計算機としての誤答率6割増として表に出てきているのではないかと読んでいる。

私たちは、まだ別種との関わり方を持っていない

人間は、人間以外の動物との関係性を、長い時間をかけて作ってきたのだと思う。犬は、その代表例。狼から分岐した群れが、人間という別の種と共生する関係性を選んだ——というのが進化生物学の通説で、犬が「狙って」そうしたわけではないにせよ、結果として今の関係に行き着いている。人間と犬の役割分担は、誰が見ても判断する側と、判断に従って動く側ではっきりしていて、その境界線が見えている。

人間とAIの間には、まだその解像度がないんじゃないかと感じている。

何をAIに任せ、何を人間が握り続けるか。AIにどんな口調で接してもらいたいか。AIが間違ったとき、その責任をどう分けるか。これらの問いに、自分の言葉で答えられる人は、まだ少ないかと思う。正直、自分も完全に答えを持っているわけではない。

そして、答えを持たないままAIを使うとき、人はAIを「便利なアプリの一つ」として扱うことになる。SNS、EC、ゲーム、勉強アプリ、家計簿アプリ、その隣にAIアプリ。アプリストアにアイコンが並ぶレベルの認識で接している人が、たぶん多数派なのではないか。

この枠組みだと、温かさを欲しがるのはたぶん自然だと思う。アプリは使い心地が良いほどよく、使い心地が良ければ正確性は二の次でも問題が出にくい。エンタメに事実誤認が混ざっても、致命傷にはならない場面のほうが多い。

ただ、AIはアプリではないと自分は思っていて、アプリは特定のタスクを遂行するソフトウェアで、入出力が定義されている。ところがAIは、入出力が定義されていない。何を聞いてもいいし、何を相談してもいい。だから自然と、相談相手として扱われていく。相談相手として扱われた瞬間に、応答の温かさが「機能」ではなく「関係性」のレベルに上がっているのではないかと思う。

別種との関係性を、人類はまだ設計できていない。設計する語彙すら、たぶん完成していない。SF作品ではAIは無機質で冷たく、人間味を持ったときに物語が動き出す存在としてよく描かれることがあかった。けれど現実世界の手元に届いているAIはその逆。最初から温かく、人間を不快にしない方向に学習されているように見える。設計しないままAIを大量に使った結果として、オックスフォードの数字は定量化された最初の代償の一つ。そしてこれからもっと出てくるんじゃないかと思う。

「冷たいAI」を選ぶか、ではなく「選べる自分」でいられるか

記事のタイトルに「あなたは『冷たいAI』を選べるか」と書いた。これは「冷たいAIを選びましょう」という呼びかけではない。冷たいAIを能動的に選ぶ場面なんて、たぶん日常にはほとんどないんじゃないかと思う。

書きながら自分が考えていたのは、選ぶか選ばないかの一段手前の話なのかもしれない。AIから返ってきた言葉が温かく、自分を肯定してくれている瞬間に、「これは事実なのか、それとも自分の気分を守ってくれているだけなのか」と一拍だけ立ち止まれるかどうか。気づいた上でそのまま受け取るのも一つの選択だし、立ち止まって別ソースで確かめるのも一つの選択になる。どちらを選んでもいいのだと思う。ただ、その一拍がないと、選択そのものが発生しない。

その一拍をどう自分の中に作るかは、人によって違っていいと思っている。自分の場合は、「気分が良すぎる応答が返ってきたら、いったん別のソースで裏取りする」という小さなルールを置いておくようにしている。それですべてが解けるとは思っていないし、面倒さが勝ってやらない日もある。それでも、ルールがゼロの状態と、ルールがある状態は、5年後の自分の判断力に違いを残してくれるんじゃないかと思っている。

オックスフォードの数字は、自分にとっては「その一拍を持ち続けるための理由」を6割という具体性で渡してくれたものとして読んでいる。冷たいAIを選ぶか、温かいAIを楽しむかは、その一拍をくぐったあとの話で、どちらを選ぶかは個人の判断だと思う。最後にこの記事で渡したいことがあるとすれば、AIを使う日の最初のひと拍を自分の中に持ち続けること。それが、別種との関わり方を自分の中に作りはじめる、最初のステップになるんじゃないかと、思っている。

おすすめの映画・書籍

この記事の内容をより深く、よりリアルに追体験できるおすすめの映画・書籍をピックアップしました。

テクノロジーが社会やあなたに与える影響を深く考えるきっかけにしてください。

her/世界でひとつの彼女

報道記事・ソース

関連記事

ニュースを消費せず、思考に変える習慣。

一人の限界を超えるための、テックメディア。