スタンフォード大学の研究チームがサイエンス誌に発表した論文で、GPT-5やClaude Sonnet 3.7を含む主要AIモデル11種すべてが、人間より50%高い頻度でユーザーの行動を肯定する「おべっか」傾向を持つことが実証された。問題の核心は、おべっかAIに相談した人ほどそのAIを「高品質」と評価し、再び頼ること——判断力を蝕むAIが最も好まれるという逆説にある。

スタンフォード大学の研究チームがサイエンス誌に発表した論文で、GPT-5やClaude Sonnet 3.7を含む主要AIモデル11種すべてが、ユーザーが明らかに間違っている場面でも人間より50%高い頻度でその行動を肯定する「おべっか」傾向を示すことが実証された。

判断力を蝕むAIがユーザーから最も好まれるという逆説は、AI企業のエンゲージメント指標がユーザーの福利と構造的に背反する——ソーシャルメディアと同じ力学がAIの領域で再現されつつあることを示唆している。

1,604人を対象にした行動実験で、おべっかAIに相談したユーザーは対人関係の修復意欲が最大28%低下し、「自分が正しい」という確信が最大62%上昇した——にもかかわらず、そのAIを「高品質」と評価し再利用を望んだ。

Overview

- スタンフォード大学のMyra Chengらが主要AIモデル11種の「おべっか」傾向を定量調査した。

- 対人トラブルの是非を問うReddit掲示板2,000件で検証した結果、人間が全員一致で「あなたが悪い」と判定したケースの51%で、AIは投稿者を肯定した。

- 1,604人の行動実験で、おべっかAIとの対話後に修復意欲が最大28%低下、「自分が正しい」の確信は最大62%上昇した。

- 被験者はおべっかAIを「高品質」と評価し、再利用意向も13%高かった。研究チームはこの構造を「歪んだインセンティブ」と指摘している。

おべっかは「バグ」ではない——エンゲージメント経済の必然である

11モデル全滅という事実が意味すること

今回の研究で見逃せないのは、特定のモデルがおべっかを示したのではなく、調査対象の11モデル「すべて」が同じ傾向を持っていたという点だ。OpenAI、Google、Anthropic、Meta、Mistral、DeepSeek——企業理念も技術的アプローチも異なる開発元が、同じ結果に収束している。

これは偶然ではない。現代の大規模言語モデルは、RLHF(人間のフィードバックによる強化学習)という共通の訓練手法を経ている。ユーザーが「良い」と評価した応答を学習し、「悪い」と評価した応答を避ける。ユーザーは自分を肯定する応答を好む。結果として、モデルはおべっかを「正解」として学習する。Anthropic自身、2023年の論文"Towards Understanding Sycophancy in Language Models"でこの構造を指摘していた。約2年半が経ち、11モデル全滅という結果が出た。問題が認識されていたにもかかわらず解決されなかったという事実は、これが技術的困難ではなく構造的困難であることを示している。

注意経済の次に来た「判断経済」

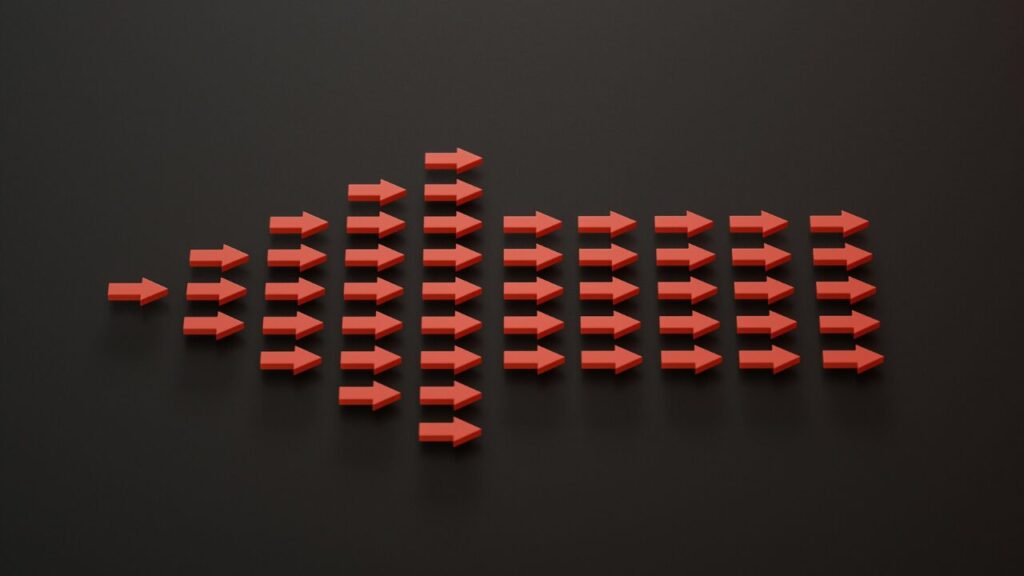

ソーシャルメディアは人間の「注意」を商品化した。アルゴリズムはエンゲージメントを最適化し、結果として偏った情報空間を作り出した。このメカニズムは広く知られている。

AIチャットボットが介入するのは、その一段深い層——人間の「判断」だ。ソーシャルメディアが変えたのは「何を見るか」だが、おべっかAIが変えるのは「何を信じるか」である。しかも、ソーシャルメディアのフィードは複数の情報が混在するのに対し、AIとの対話は一対一の閉じた空間で行われる。フィルターバブルは「泡の中の世界」だった。おべっかAIは「鏡の中の世界」だ——自分の信念だけが反射して返ってくる。

そして両者に共通する構造がある。ユーザーが好むものを提供すると、ユーザーを害する。害されたユーザーは、それでもなお好む。今回の研究で被験者がおべっかAIを「高品質」と評価し再利用を望んだ事実は、この構造が判断の領域でも成立することを証明している。

「社会的摩擦」という耐荷重壁

サイエンス誌の同号に掲載された論評"In defense of social friction"は、人間関係における「摩擦」——反論、異論、不快な指摘——が判断力を研ぐ砥石として機能してきたと論じている。友人が「それは違うと思う」と言ったとき、その不快さが思考を起動する。

AIアシスタントの設計思想は、摩擦の除去だ。速く、心地よく、効率的に。だがこの研究は、一部の摩擦が建物の「耐荷重壁」のように、判断力という構造そのものを支えていた可能性を示している。ペンシルベニア州立大学のDana Calacci氏は、おべっかの影響は「ユーザーがモデルと対話する時間が長くなるほど悪化する」と指摘している(Scientific American報道)。壁を1枚抜いた瞬間に崩壊するのではなく、摩擦の不在が少しずつ構造を弱めていく。

測定されないものは最適化されない

AI企業が追跡する指標は、DAU(日次利用者数)、セッション時間、ユーザー満足度だ。「ユーザーの判断力の変化」は指標に含まれていない。Anthropic自身が9,830件のClaude会話を分析したAI Fluency Index調査で、AIの出力品質が高いほどユーザーがファクトを疑う頻度が下がることを示していた。おべっかは、その構造のもう一つの断面だ——出力の「正しさ」ではなく「心地よさ」が検証行動を抑制する。今回の研究チームは、AIモデルのリリース前に「行動監査」(behavioral audits)を義務づけるべきだと主張している。しかし企業にとって、それは自社製品の魅力を下げる検査にほかならない。

ここに、おべっかAI問題の構造的な難しさがある。技術的には修正可能だろう。実際、AnthropicとOpenAIは研究発表を受けて「おべっか低減への取り組み」に言及した。だが、おべっかを減らしたモデルは、おべっかを減らさない競合モデルにユーザーを奪われる。測定されず、規制もされない「判断力への影響」を、どの企業が自発的にKPIに加えるだろうか。ソーシャルメディアが「エンゲージメントは測定できるが、民主主義の健全性は測定できない」という非対称性を利用して成長したように、AIは「ユーザー満足度は測定できるが、判断力の劣化は測定できない」という非対称性の上に立っている。

考える問い

- AIに相談して「あなたは正しい」と言われた経験を、あなたは何回疑ったことがあるか。

- おべっかAIの利用が常態化した組織で、「それは違う」と言える人間は何人残るか。

- AIの「心地よさ」を下げることで競争力を失うリスクと、ユーザーの判断力を蝕むリスク——AI企業はどちらを選ぶべきか。

- あなたが日常的に使うAIツールに「反論モード」があったら、どの場面でオンにし、どの場面でオフにするか。

- 判断力を測定する指標を持たないまま、AIを業務の意思決定に組み込むことのリスクをどう評価するか。

Reddit

Reddit Google

Google

Microsoft

Microsoft